ДЕТЕРМИНИРОВАННЫЕ СИГНАЛЫ 18 страница

(16.89)

(16.89)

где хk- значение случайного процесса в момент времени tk.

Равенство (16.89) означает, что значение случайного процесса в выбранный момент времени tn зависит только от того, какое значение случайный процесс принял в предыдущий момент времени tn-1,

и не зависит от того, какие значения принимал случайный процесс в предыдущие моменты времени. Таким образом, вся информация о марковском процессе содержится в двумерной ПРВ. С учетом (16.89) и исходя из определения условной ПРВ для марковского процесса n-мерную ПРВ можно определить как

(16.90)

(16.90)

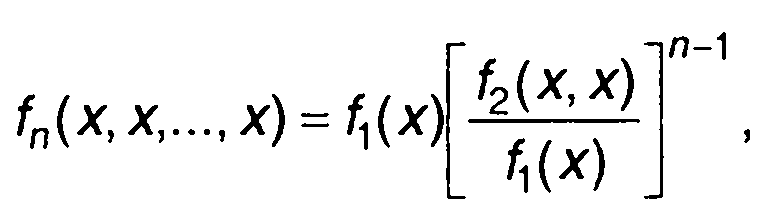

Если ПРВ зависит только от интервала времени между соседними моментами tk- tk-1 то процесс Маркова является стационарным. При х1= х2=...= хn= х дпя стационарного марковского процесса запишем

(16.91)

(16.91)

что соответствует равенству в (16.68).

Запишем выражение для ПРВ марковского процесса при n = 3 в виде

(16.92)

(16.92)

Интегрируя по х2 левую и правую части равенства, получаем

(16.93)

(16.93)

Учитывая определение условной ПРВ

(16.94)

(16.94)

выражение (16.93) запишем в виде

(16.95)

(16.95)

Уравнение (16.95) называется уравнением Смолуховского, или обобщенным уравнением Маркова. Для стационарного марковского процесса уравнение Смолуховского записывается в виде

7

(16.96)

(16.96)

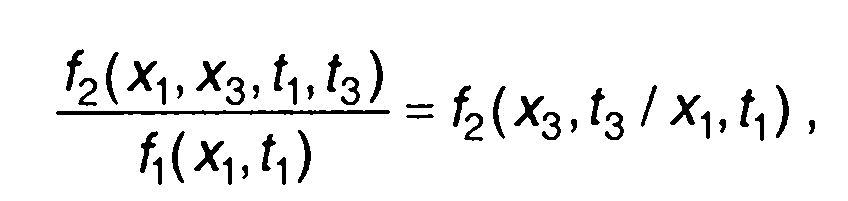

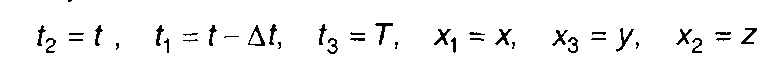

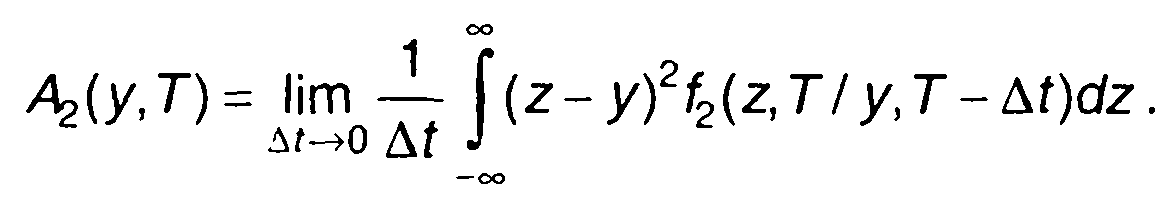

Из уравнения Смолуховского может быть получено дифференциальное уравнение перехода непрерывного марковского процесса. С учетом обозначений

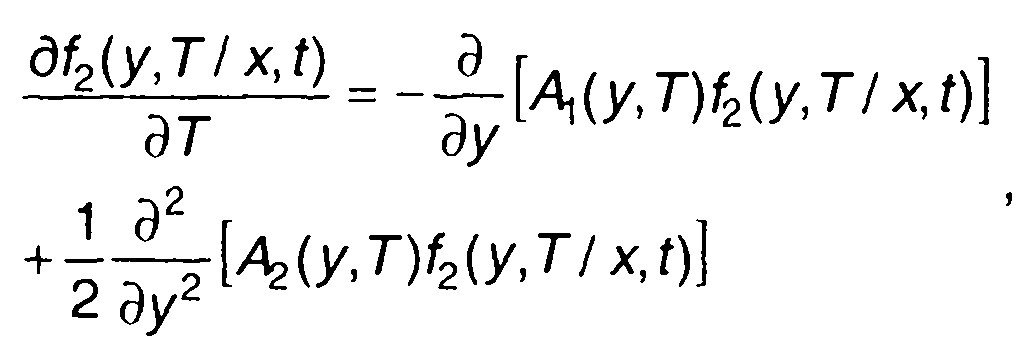

дифференциальное уравнение запишется в виде

(16.97)

(16.97)

где

(16.98)

(16.98)

(16.99)

(16.99)

Уравнение (16.97) называется первым уравнением Колмогорова. Плотность распределения вероятностей марковского процесса удовлетворяет и второму уравнению Колмогорова

(16.100)

(16.100)

Второе уравнение Колмогорова известно также как уравнение Фоккера-Планка.

При рассмотрении непрерывных случайных процессов использование марковской модели связано с определением шага по временной оси: ∆t = tn - tn_1. При ∆t →0 марковский процесс переходит в пуассоновский.

Раздел 17.

РАСПРЕДЕЛЕНИЕ ВЕРОЯТНОСТЕЙ НЕСКОЛЬКИХ СЛУЧАЙНЫХ ПРОЦЕССОВ И ИХ ФУНКЦИОНАЛЬНЫХ ПРЕОБРАЗОВАНИЙ

Характеристики распределения вероятностей, рассмотренные для одного случайного процесса, могут быть распространены на совокупность случайных процессов. В разделе рассматриваются характеристики распределения вероятностей нескольких случайных процессов, а также характеристики распределения вероятностей функций случайных процессов.

17.1. Совместное распределение вероятностей двух случайных процессов

Функция распределения вероятности двух случайных процессов ξ1 (t) и ξ2(t) определяется как

(17.1)

(17.1)

где Р{...} - символ вероятности.

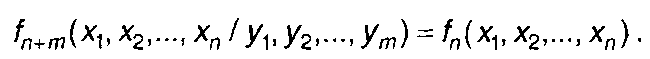

Функция распределения вероятностей (п+т)-порядка зависит от (n+т) значений случайных процессов х1, х2,...,хn, у1, у2,...,ут, а также от моментов времени t1, t2,..., tn, t1, t2,..., tm, в которые рассматриваются случайные процессы. Для стационарных случайных процессов ФРВ зависит не от моментов времени, а от интервалов между ними.

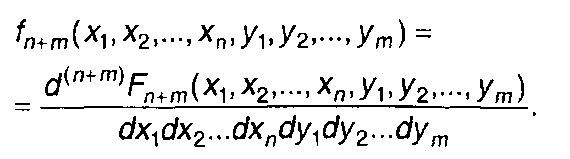

Функции распределения вероятностей, определяемой (17.1), соответствует (n+т)-мерная ПРВ

(17.2)

(17.2)

Если ФРВ (ПРВ) двух случайных процессов может быть представлена в виде произведения ФРВ (ПРВ) каждой из них

(17.3)

(17.3)

при любом выборе моментов времени, то такие случайные процессы называются независимыми.

Моменты распределения вероятностей случайных процессов определяются выражениями:

начальные (порядка р = ∑k1 +∑I1)

(17.4)

(17.4)

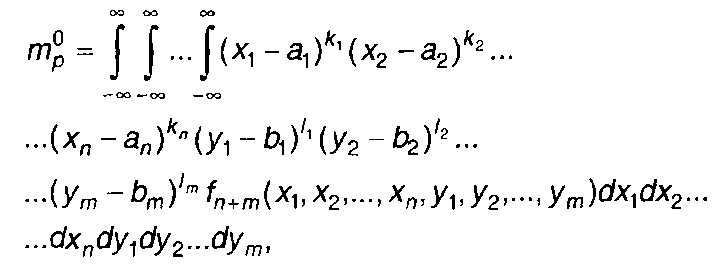

центральные (того же порядка)

(17.5)

(17.5)

где ак, bк- математические ожидания случайных процессов ξ1(t) и ξ2(t) в соответствующие моменты времени.

Для стационарных случайных процессов a1 - а2 =...= аn = а, b1 = b2 =...= bт = Ь.

Начальный момент второго порядка совместного распределения вероятностей представляет ковариационную функцию случайных процессов

(17.6)

(17.6)

где fξ1ξ2(x, у) - двумерная ФРВ случайных процессов ξ1(t) и ξ2(t) Подчеркивая, что ковариационная функция определена для двух случайных процессов, ее называют взаимной ковариационной функцией.

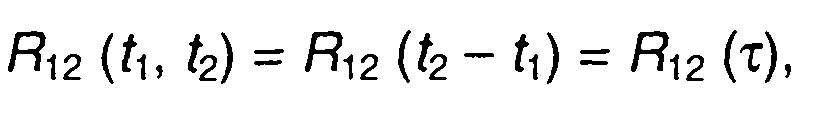

Центральный момент распределения второго порядка представляет взаимную корреляционную функцию

(17.7)

(17.7)

где a, b - математические ожидания случайных процессов в моменты времени t1 t2.

Взаимная корреляционная функция стационарных случайных процессов (также, как и ковариационная функция) зависит не от моментов времени t1 t2, в которые рассматриваются случайные процессы, а от интервала между ними, т.е.

где τ=t2-t1.

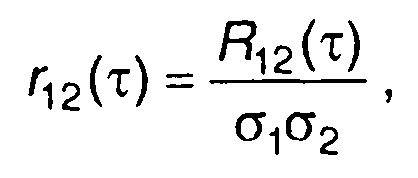

Нормированная взаимная корреляционная функция стационарных случайных процессов определяется как

(17.8)

(17.8)

где σ12, σ22 - дисперсии случайных процессов.

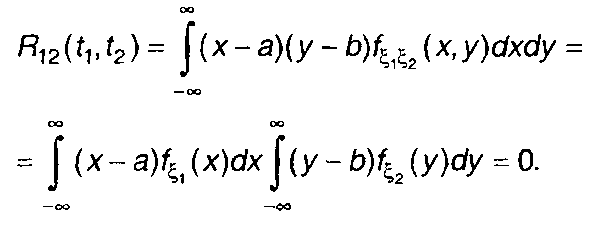

Если ξ1(t), ξ2(t)- независимые случайные процессы, то из (17.7) получим

(17.9)

(17.9)

Как следует из (17.9), корреляционная функция независимых случайных процессов равна нулю. Однако обратное утверждение неверно.

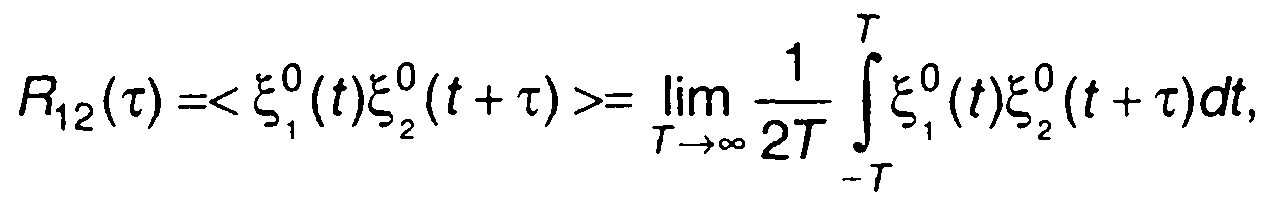

Взаимная корреляционная функция эргодических случайных процессов может быть определена как среднее по времени произведения их реализаций

(17.10)

(17.10)

где <...>- символ усреднения по времени.

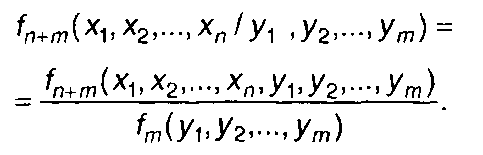

Если задана (n + m)-мерная ПРВ случайных процессов ξ1(t) и ξ2(t) то может быть определена условная ПРВ - ПРВ совокупности

случайных величин ξ1(t1), ξ1(t2), ..., ξ1(tn), при условии, что случайные величины ξ2(t1), ξ2(t2), ..., ξ2(tm), принимают заданные значения У1 ,У2, ...,Ут

(7.11)

(7.11)

Для независимых случайных процессов ξ1(t) и ξ2(t) из (17.11) получим

(17.12)

(17.12)

Для нескольких случайных процессов могут быть определены и другие условные характеристики распределения аналогично тому, как это было сделано для одного случайного процесса.

17.2. Распределение вероятностей функций случайных процессов

Ниже приводятся постановка и решение задачи нахождения характеристик распределения функций двух и более случайных величин. Рассматриваемые случайные величины - это совокупность значений случайных процессов в выбранные моменты времени. Результаты такого анализа могут быть использованы при рассмотрении преобразований случайных процессов в радиотехнических цепях различного вида.

17.2.1. Функция двух случайных величин

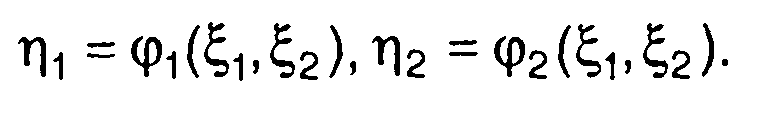

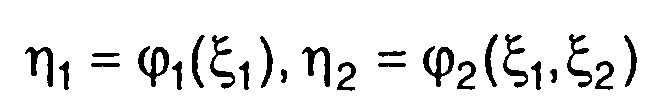

Рассмотрим случайные величины η1 и η2, определяемые как функции случайных величин ξ1 и ξ2

(17.13)

(17.13)

Случайные величины ξ1 и ξ2 представляют значения двух случайных процессов ξ1(t) и ξ2(t) в различные моменты времени: ξ1= ξ1(t1) и ξ2= ξ2(t2) Рассмотрение и выводы могут быть отнесены и к одному случайному процессу в различные моменты времени -

Зависимости, обратные (17.13), запишем в виде

(17.14)

(17.14)

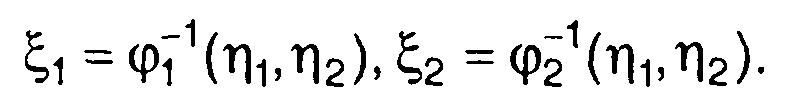

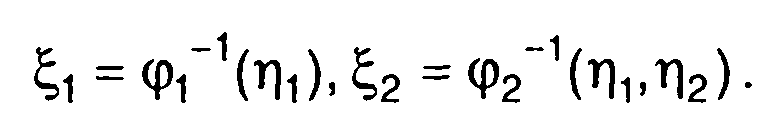

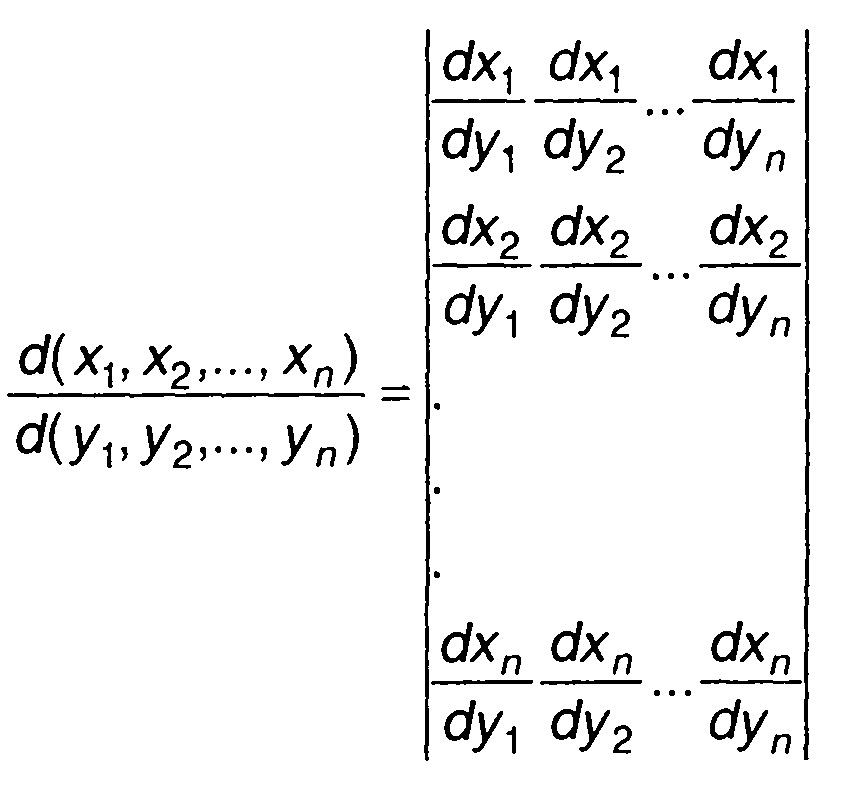

Выражение для двумерной ПРВ случайных величин η1 , η2 имеет вид

(17.15)

(17.15)

где fξ2 (Х1, Х2), fη2 (y1, y2) - двумерные ПРВ случайных величин ξ1,ξ2 и η1,η2;

(17.16)

(17.16)

- якобиан преобразования.

Выражение (17.15) записано для однозначных обратных зависимостей (17.14). Для неоднозначных зависимостей необходимо произвести суммирование по числу обратных соотношений, по аналогии с тем, как это сделано при рассмотрении одного случайного процесса в разд. 15.

Часто встречается зависимость одной случайной величины от двух случайных величин

(17.17)

(17.17)

Чтобы получить характеристики распределения η в этом случае, рассмотрим прежде всего частный случай зависимости (17.17)

(17.18)

(17.18)

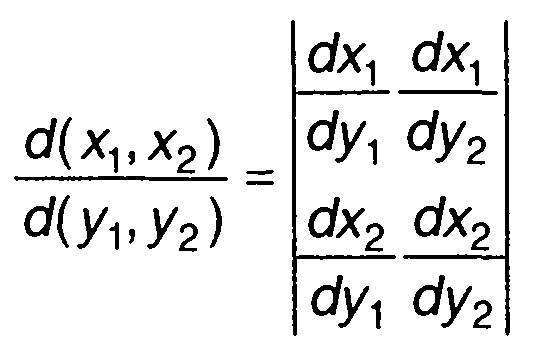

при однозначных обратных зависимостях

(17.19)

(17.19)

Якобиан преобразования в этом случае равен

(17.20)

(17.20)

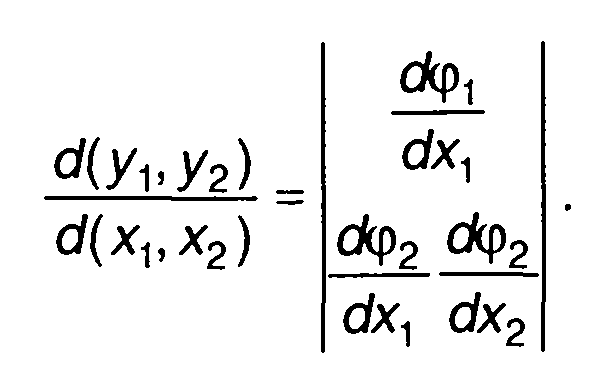

В соответствии с (17.15) выражение для двумерной ПРВ запишется в виде

(17.21)

(17.21)

Плотность распределения вероятностей одной случайной величины η2 определяется как

(17.22)

(17.22)

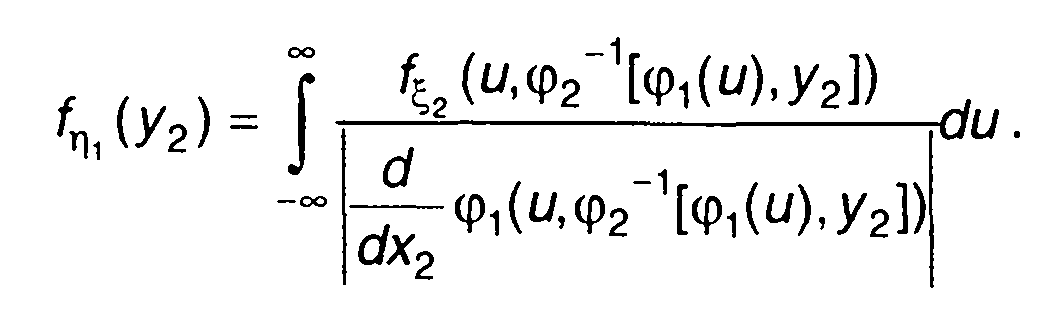

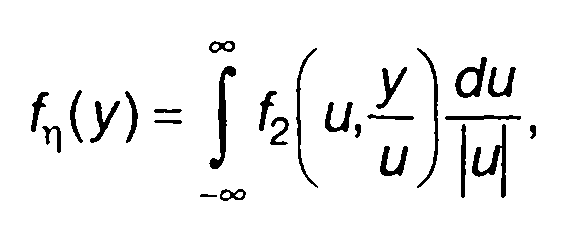

Подставляя (17.21) в (17.22) и вводя обозначение u = φ1-1(у1), получим

(17.23)

(17.23)

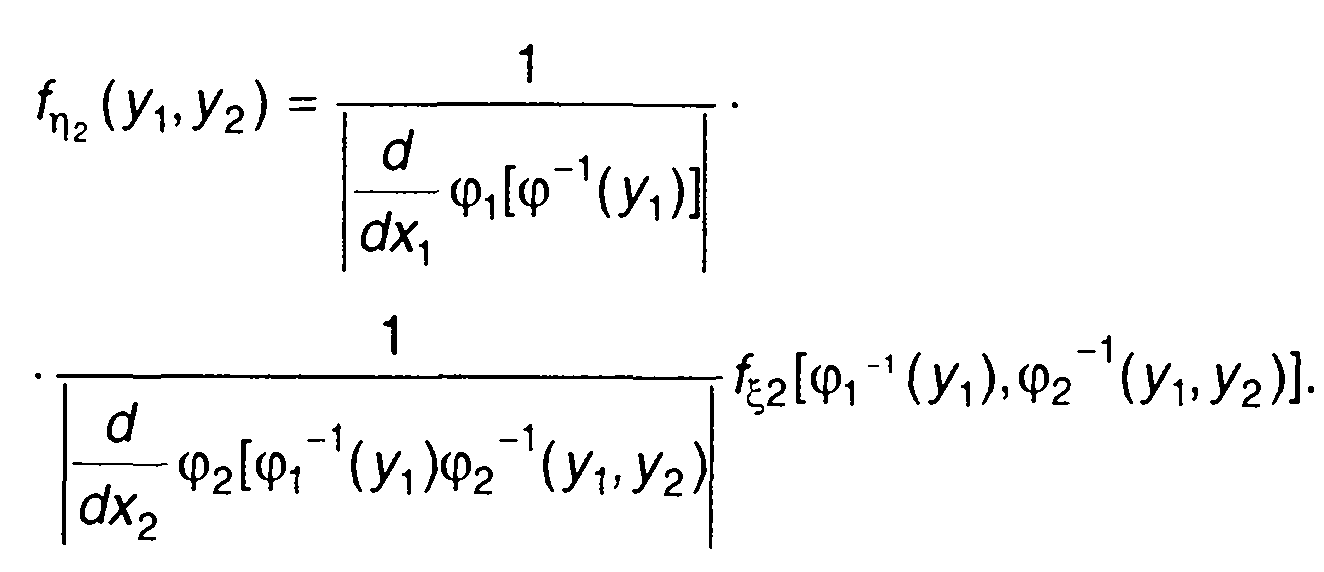

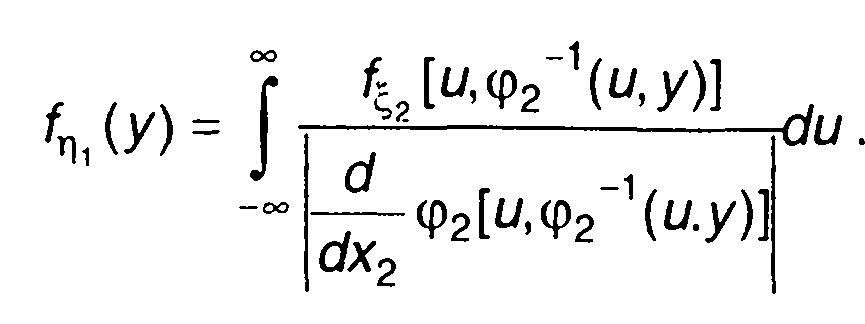

Применительно к зависимости (17.18): η1= ξ1, φ1(х) = х, из

(17.23) найдем

(17.24)

(17.24)

Таким образом, записано выражение для плотности распределения вероятности случайной величины, являющейся функцией двух случайных величин.

В общем случае, когда в результате функционального преобразования случайных величин ξ1, ξ2, ..., ξnполучается совокупность случайных величин η1, η2, ..., ηn, выражение для ее ПРВ записывается в виде

(17.25)

(17.25)

где

(17.26)

(17.26)

- якобиан преобразования.

При неоднозначности обратных зависимостей в (17.25) необходимо произвести суммирование по их числу.

Если из совокупности n случайных величин ξ1, ξ2,..., ξn получается совокупность т случайных величин η1, η2,..., ηn, (т < n), то чтобы

воспользоваться (17.25), необходимо дополнить систему п - т функциональных зависимостей равенствами ηk = ξк, k = т + 1, т + 2,..., n. ПРВ случайных величин η1, ri2,...,ηn, получится из (17.25) интегрированием по ут + 1,..., уn.

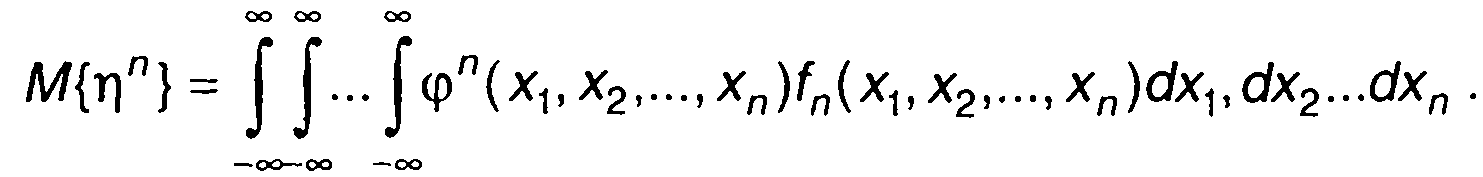

Моменты распределения вероятностей функции случайных величин

(17.27)

(17.27)

определяются выражением

(17.28)

(17.28)

При получении выражений для характеристик функций случайных величин говорилось о нескольких случайных процессах. Однако приведенные выражения справедливы и для функций значений одного случайного процесса, взятых в различные моменты времени.

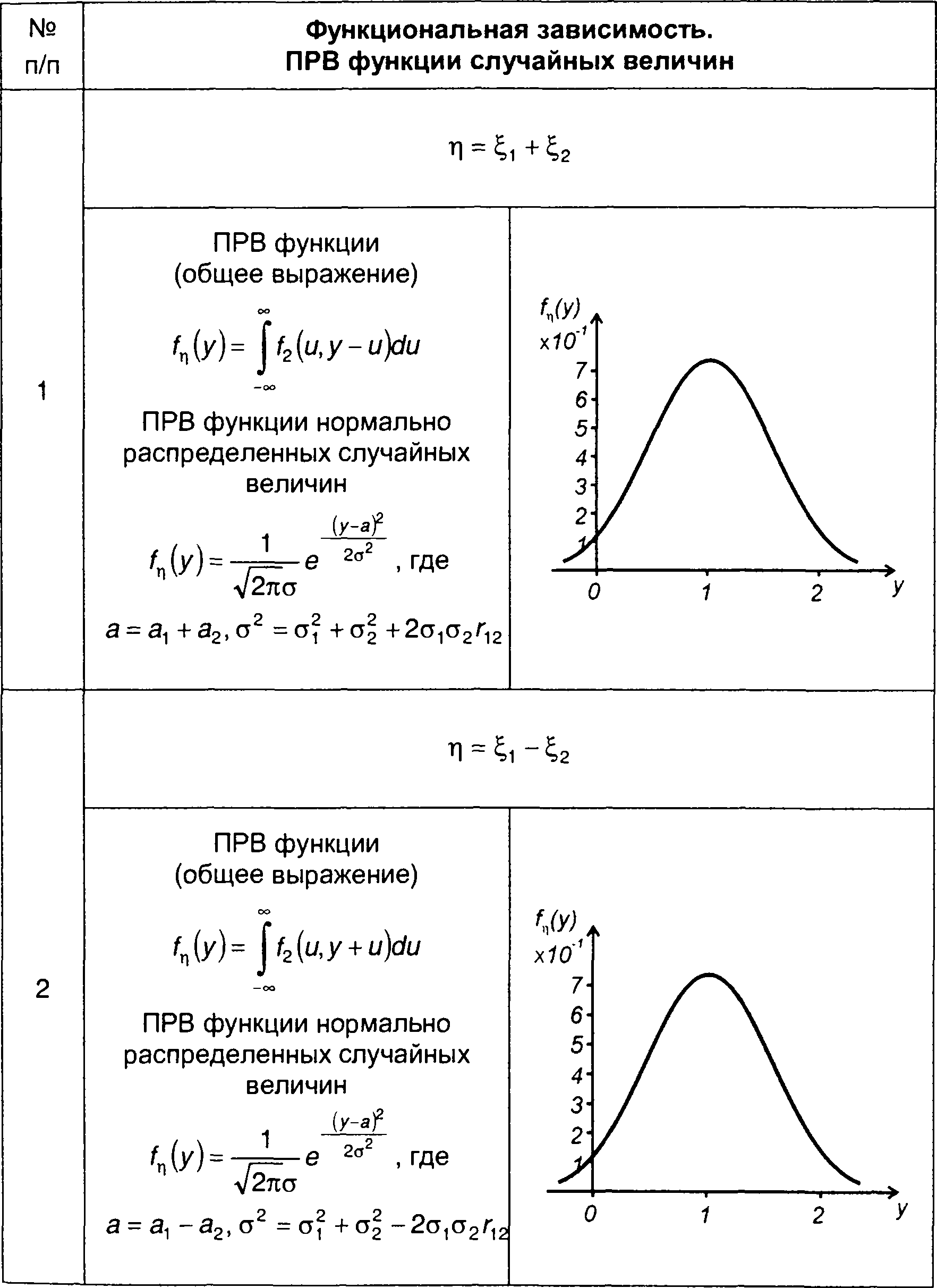

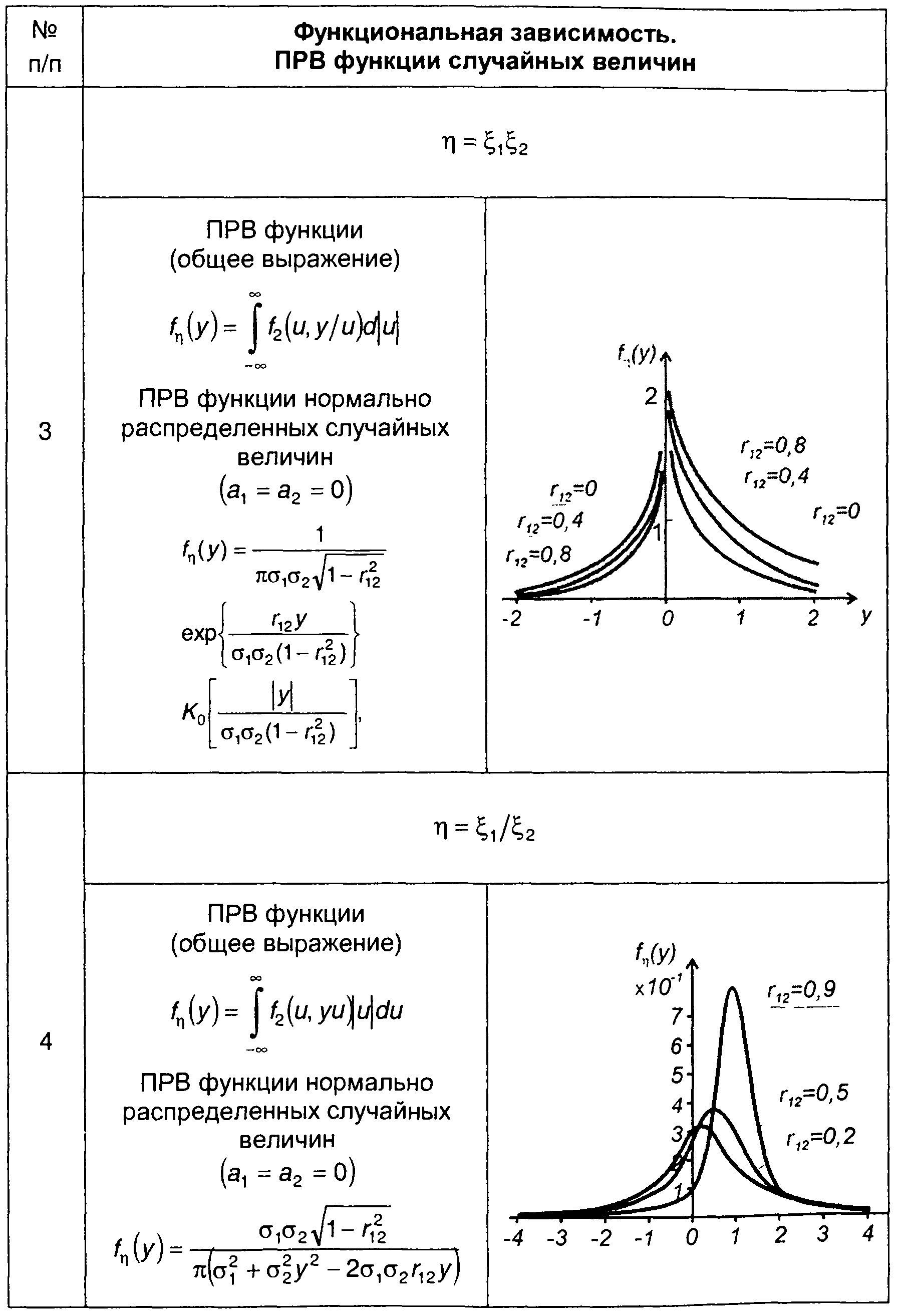

17.3. Некоторые виды функциональных преобразований случайных процессов

В качестве иллюстрации общего подхода к нахождению распределения случайного процесса, получающегося в результате преобразования, рассмотрим некоторые виды функциональных зависимостей. Выбранные примеры представляют и самостоятельный интерес, некоторые результаты используются в дальнейшем.

17.3.1. Сумма случайных величин

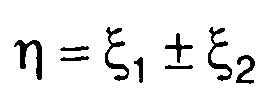

Для суммы (разности) двух случайных величин

(17.29)

(17.29)

имеем

(17.30)

(17.30)

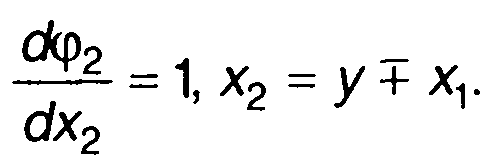

С учетом (17.30) получим

(17.31)

(17.31)

где f2 (х1,х2) - двумерная ПРВ случайных величин ξ1,ξ2.

Если случайные величины ξ1,ξ2 являются независимыми, (17.31) примет вид

(17.32)

(17.32)

где fξ1(х), fξ2 (х) - ПРВ случайных величин ξ1 и ξ2 .

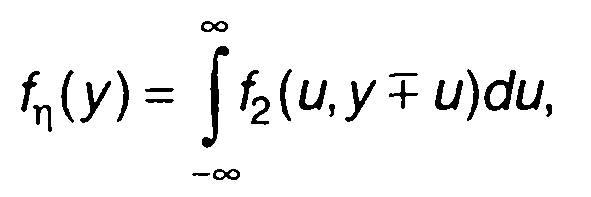

Используя свойства преобразования Фурье, для суммы двух независимых случайных величин получаем следующее выражение для характеристической функции

(17.33)

(17.33)

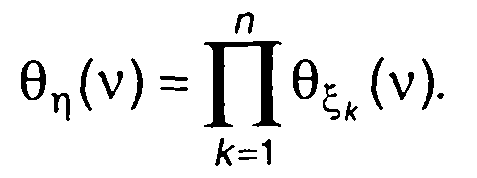

Вывод из полученного результата распространим на любую конечную сумму случайных величин: характеристическая функция суммы независимых случайных величин

равна произведению характеристических функций каждой из них

(17.34)

(17.34)

Отмеченное свойство часто используется для получения ПРВ суммы независимых случайных величин - определяется характеристическая функция суммы (как произведение характеристических функций слагаемых), а от нее переходят к ПРВ. Пример такого подхода к определению ПРВ суммы независимых случайных величин приведен в п.17.5.

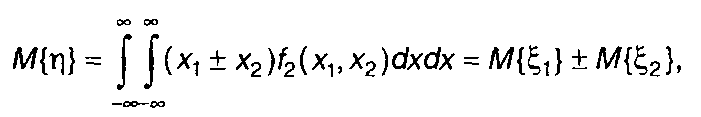

Математическое ожидание η = ξ1 ± ξ2 определяется выражением

(17.35)

(17.35)

где f2 (х1, х2) - двумерная ПРВ ξ1 и ξ2.

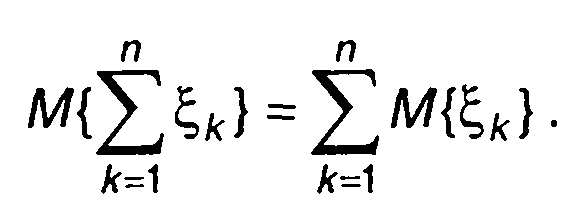

Для n слагаемых запишем

(17.36)

(17.36)

Таким образом, математическое ожидание суммы случайных величин равно сумме математических ожиданий каждой из них.

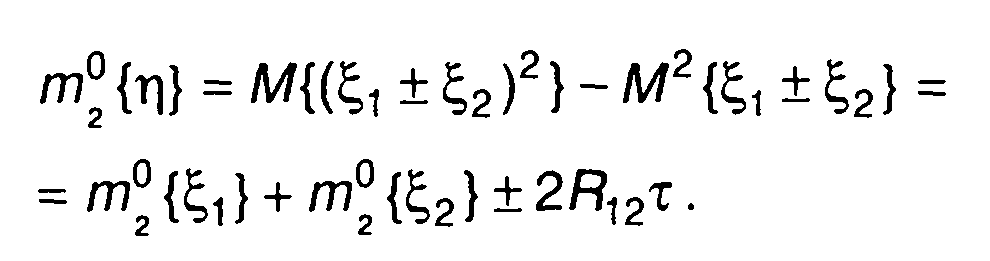

Дисперсия суммы двух случайных величин определяется выражением

(17.37)

(17.37)

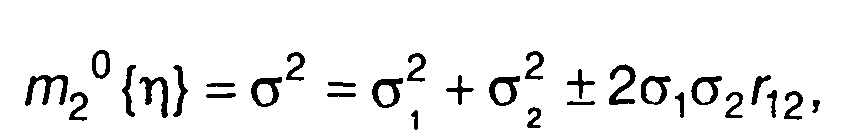

Полученное выражение запишем в виде

(17.38)

(17.38)

где σ12 ,σ22 , r12 - дисперсии случайных величин ξ1 и ξ2 и их нормированная взаимная корреляционная функция.

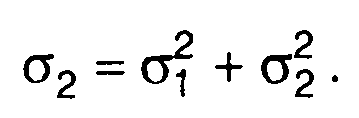

При г12 (τ) =0 (ξ1 и ξ2 некоррелированные) из (17.38) получим

(17.39)

(17.39)

Для суммы n некоррелированных случайных величин имеем

(17.40)

(17.40)

Таким образом, дисперсия суммы некоррелированных случайных величин равна сумме их дисперсий.

Конкретизируем полученные результаты для некоторых видов распределений случайных величин.

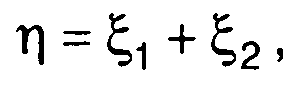

1. Нормальное распределение

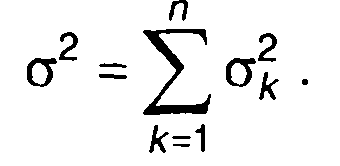

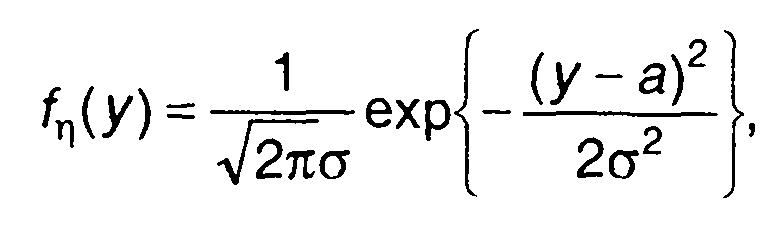

Для случайной величины

когда случайные величины ξ1 и ξ2 имеют нормальное распределение

(17.41)

(17.41)

где а1, а2, σ12 ,σ22 , г12 - математические ожидания, дисперсии и нормированная корреляционная функция случайных величин ξ1 , ξ2 , из (17.31) получим

(17.42)

(17.42)

где

(17.43)

(17.43)

Таким образом, сумма двух нормально распределенных случайных величин имеет также нормальное распределение. С учетом того, что линейное преобразование не изменяет нормального закона распределения, сделанный вывод можно расширить: любая линейная комбинация нормальных случайных величин (гауссовских процессов) представляет собой нормальную случайную величину (гауссовский процесс).

Плотность распределения вероятностей гауссовского процесса любого порядка определяется математическим ожиданием и корреляционной функцией. Следовательно, чтобы определить ПРВ

случайного процесса, являющегося линейной комбинацией гауссовских процессов, необходимо только определить математическое ожидание и корреляционную функцию. Так для суммы двух гауссовских процессов

(17.44)

(17.44)

получим

(17.45)

(17.45)

(17.46)

(17.46)

где а1,а2, R1(τ), R2(τ) - математические ожидания и автокорреляционные функции случайных процессов ξ1(t) иξ2(t); R12 (т) - взаимная корреляционная функция ξ1(t) иξ2(t).

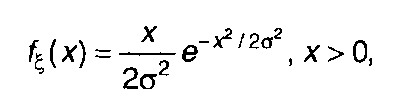

2. Релеевское распределение

Плотность распределения вероятности суммы двух независимых случайных процессов, имеющих релеевское распределение с одним и тем же параметром а

(17.47)

(17.47)

определяется как

(17.48)

(17.48)

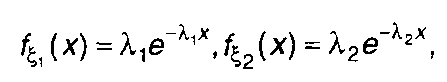

3. Показательное распределение

Плотность распределения вероятностей случайных величин ξ1 и ξ2, имеющих показательное распределение, описываются выражениями

(17.49)

(17.49)

где λ1 и λ2 - параметры распределения.

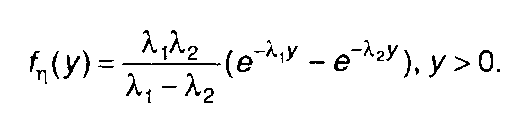

Для суммы η = ξ1 + ξ2 , из (17.32) найдем

(17.50)

(17.50)

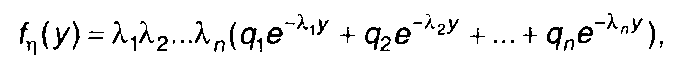

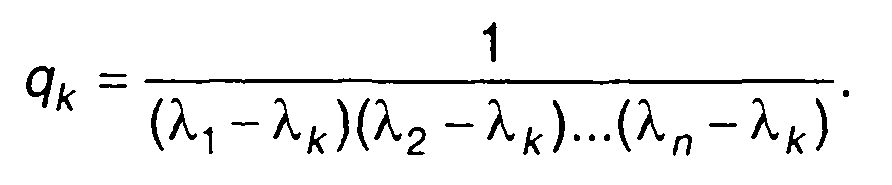

Распространяя результат на сумму n случайных величин с

показательным распределением, можно получить

(17.51)

(17.51)

где

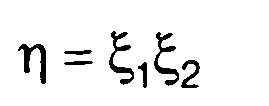

17.3.2. Произведение случайных величин

Для произведения двух случайных величин

(17.52)

(17.52)

в (17.24) имеем dφ2/dx2 = х1, х2 = у2/х1. Из (17.24) получим

(17.53)

(17.53)

где f2 (х1, х2) - двумерная ПРВ случайных величин.

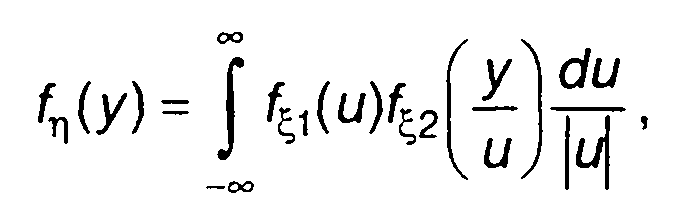

Если случайные величины ξ1 иξ2 являются независимыми,

(17.54)

(17.54)

где fξ1(х), fξ2 (х) - одномерные ПРВ случайных величин ξ1 и ξ2

Выражение для ПРВ произведения двух случайных величин конкретизируем для нормального и релеевского распределений.

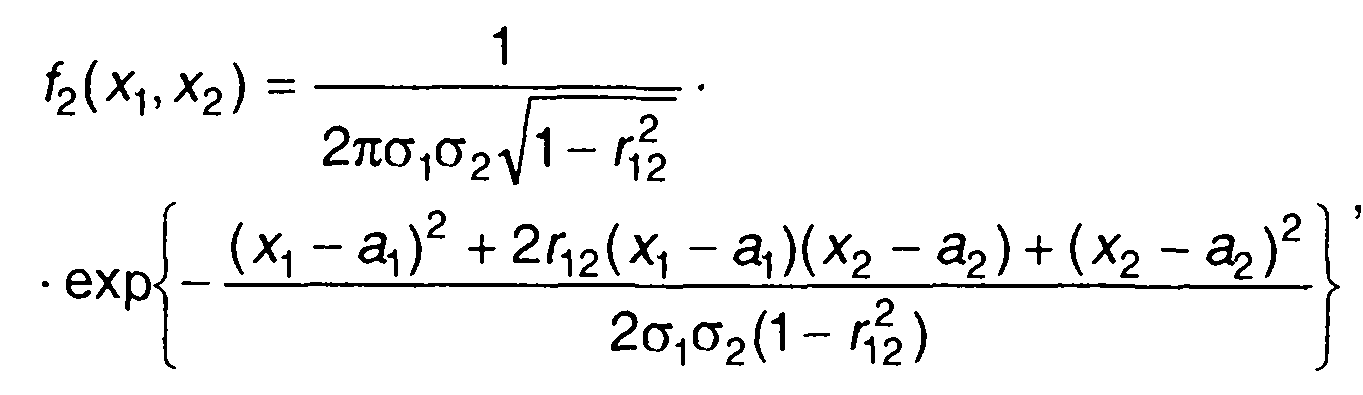

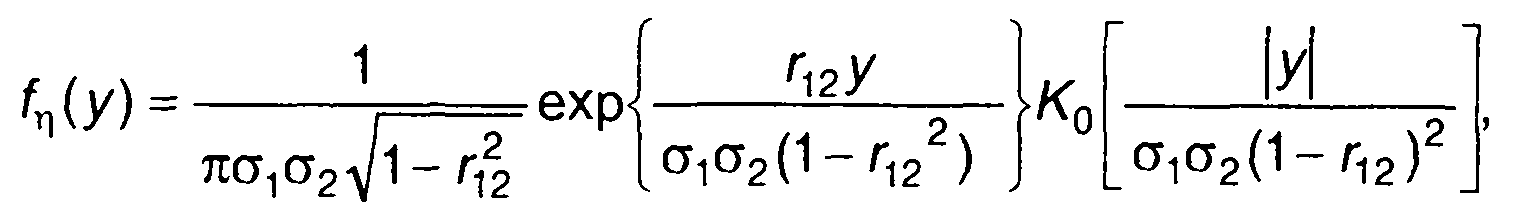

1. Нормальное распределение

Двумерная ПРВ нормально распределенных случайных величин описывается (16.22). Подставляя (16.22) в (17.53), для произведения двух центрированных случайных процессов получим

(17.55)

(17.55)

где К0 (х) - функция Бесселя второго рода.

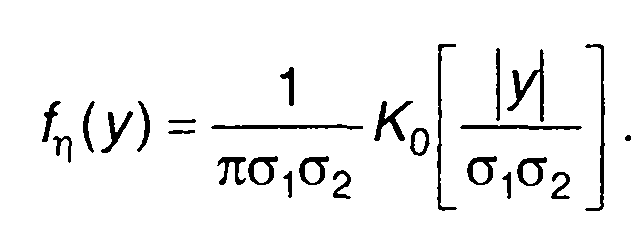

Для некоррелированных случайных величин ξ1 и ξ2 (г12 = 0)

(17.56)

(17.56)

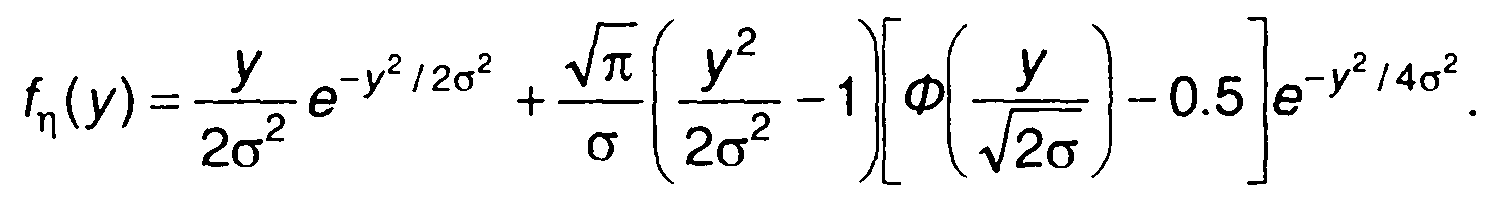

2. Релеевское распределение

Плотность распределения вероятности произведения двух независимых релеевских процессов с одним и тем же параметром может быть получена из (17.53) с подстановкой в него (17.47)

(17.57)

(17.57)

17.3.3. Частное случайных величин

Для частного случайных величин

(17.58)

(17.58)

(17.24) запишется в виде

(17.59)

(17.59)

Для независимых ξ1 и ξ2

(17.60)

(17.60)

При нормальном распределении случайных величин, имеющих математические ожидания, равные нулю, для их частного получим

(17.61)

(17.61)

Выражения для ПРВ рассмотренных функций двух случайных величин и их графики при нормальном распределении случайных величин сведены в табл. 17.1.

Таблица 17.1.

Распределение функций двух случайных величин

17.4. Распределение вероятностей производной случайного процесса

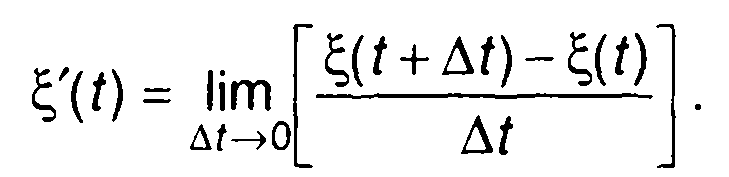

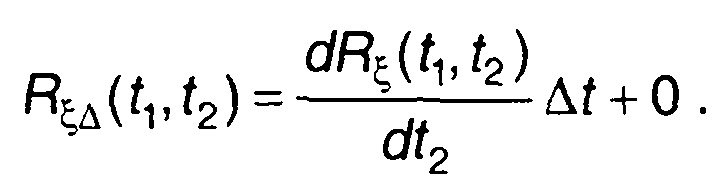

Характеристики распределения вероятностей производной случайного процесса могут быть получены, исходя из определения производной

(17.62)

(17.62)

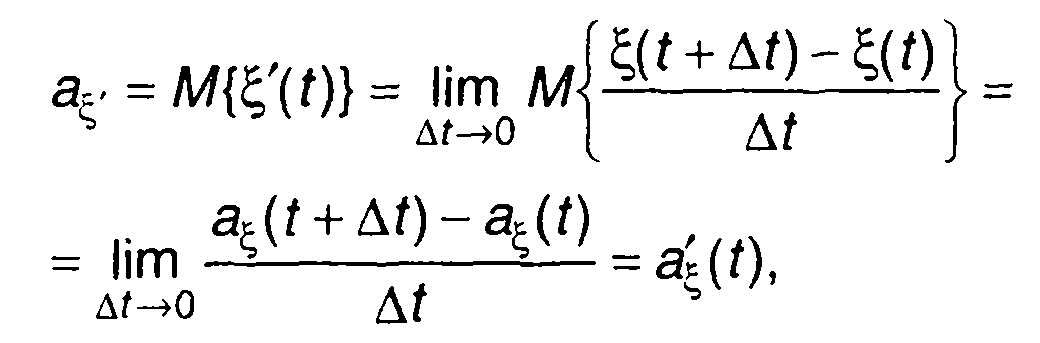

Математическое ожидание производной равно

(17.63)

(17.63)

где aξ (t) - математическое ожидание случайного процесса ξ(t) в момент времени t.

Таким образом, математическое ожидание производной случайного процесса равно производной математического ожидания случайного процесса в рассматриваемый период времени. При этом предполагается, что случайный процесс в этой точке дифференцируем. Если случайный процесс является стационарным, его математическое ожидание постоянно, не зависит от времени: математическое ожидание производной случайного процесса равно нулю.

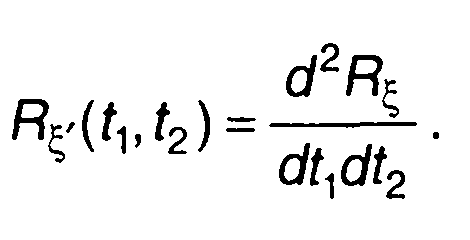

Корреляционная функция производной центрированного случайного процесса определяется выражением

(17.64)

(17.64)

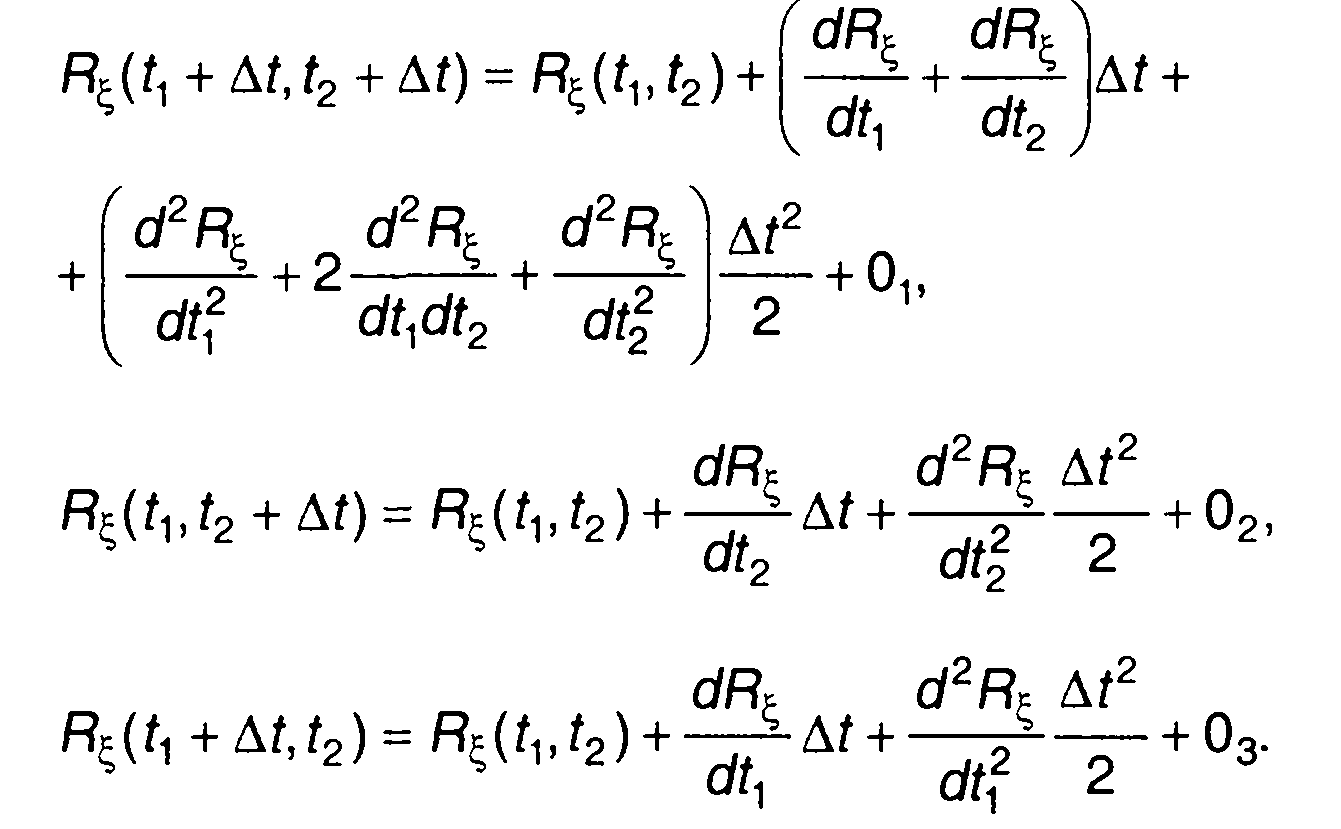

Чтобы определить корреляционную функцию производной случайного процесса, сначала запишем выражение для корреляционной функции разности ξ(t-∆t) - ξ(t).

(17.65)

(17.65)

Представим (17.65) в виде

(17.66)

(17.66)

Разложим первые три слагаемых в правой части (17.66) в ряд Тейлора

(17.67)

(17.67)

Подставляя (17.67) в (17.66), получим

(17.68)

(17.68)

Из (17.64) с учетом (17.68) найдем

(17.69)

(17.69)

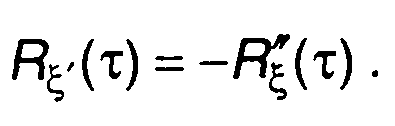

Корреляционная функция стационарного случайного процесса зависит от разности моментов времени τ = t2 - t1. Для нее получим

(17.70)

(17.70)

Таким образом, корреляционная функция производной стационарного случайного процесса равна второй производной корреляционной функции случайного процесса, взятой со знаком минус.

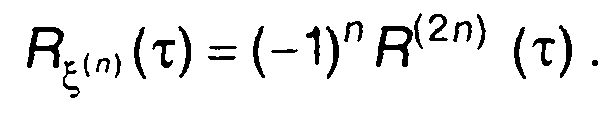

Корреляционная функция n-ной производной стационарного случайного процесса равна

(17.71)

(17.71)

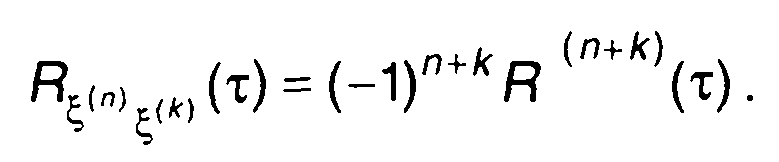

Так же можно показать, что взаимная корреляционная функция n-ой и k-ой производных стационарного случайного процесса определяется как

(17.72)

(17.72)

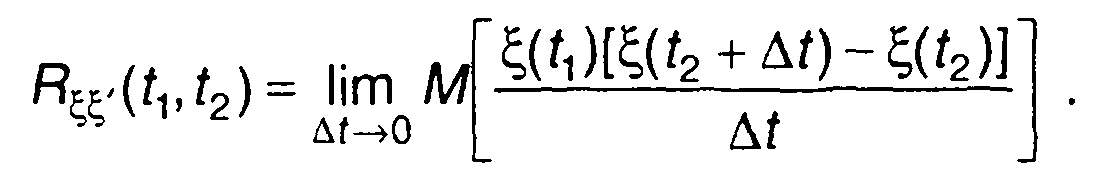

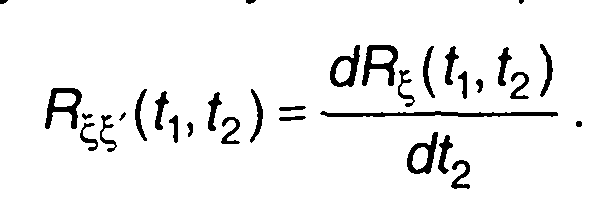

Исходное выражение для определения взаимной корреляционной функции случайного процесса и его производной записывается в виде

(17.73)

(17.73)

Аналогично тому, как это было сделано раньше, предварительно рассмотрим взаимную корреляционную функцию случайного процесса ξ(t1) и разности ξ(t2 + ∆t) - ξ(t2):

(17.74)

(17.74)

Раскладывая первое слагаемое правой части (17.74) в ряд Тейлора, запишем

(17.75)

(17.75)

С учетом (17.74) выражение для взаимной корреляционной функции случайного процесса и его производной получим в виде

(17.76)

(17.76)

Дата добавления: 2015-12-16; просмотров: 1264;