Алгоритм обучения "победитель забирает все" для задачи классификации

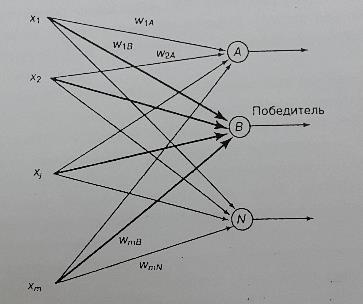

В алгоритме "победитель забирает все" при предъявлении сети входного вектора возбуждается единственный нейрон, наиболее точно соответствующий этому образу. Подобный алгоритм можно рассматривать как реализацию механизма конкуренции между нейронами сети (рис. 12). На рис. 12 вектор входных значений Х=(х1 , х2 , ..., хm) передается слою нейронов сети А, В, ..., N, причем нейрон B оказывается победителем, а его выходной сигнал равен 1.

Рис. 12. Слой нейронов при работе алгоритма "победитель забирает все". Нейрон-победитель определяется на основе входных векторов

Алгоритм "победитель забирает все" реализует принцип обучения без учителя, поскольку нейрон-победитель выбирается по максимальному уровню активности. Вектор весовых коэффициентов нейрона-победителя модифицируется для более точного соответствия входному вектору.

Если W – вес нейрона-победителя, а X – входной вектор, то вектор W модифицируется следующим образом

∆Wt = c ( Xt-1 – Wt-1),

где с – малый положительный параметр обучения, который обычно уменьшается в процессе обучения. Вектор весовых коэффициентов нейрона-победителя настраивается путем добавления к нему ∆Wt.

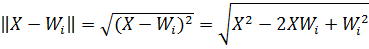

Каждый компонент вектора весовых коэффициентов увеличивается или уменьшается на величину (xi –wi). Целью такой настройки является максимальное приближение нейрона-победителя к входному вектору. Алгоритм "победитель забирает все" не требует прямого вычисления уровней активации для поиска нейрона с наиболее сильным откликом. Уровень активации нейрона напрямую зависит от близости вектора весов входному вектору. Для i-го нейрона с нормализованным вектором весовых коэффициентов Wi уровень активации WiX – это функция евклидового расстояния между Wi и входным образом X. В этом можно убедиться, вычислив евклидово расстояние для нормализованного вектора Wi

.

.

Cреди всех нормализованных векторов весовых коэффициентов максимальный уровень активации WX соответствует векторам с минимальным евклидовым расстоянием ||Х-W||.

Преимущества правила обучения Кохонена "победитель забирает все":

1) является методом классификации, который можно сравнить с эффективностью персептрона;

2) его можно комбинировать с другими нейросетевыми архитектурами и обеспечить более сложные модели обучения.

Модификации алгоритма "победитель забирает все":

1) добавление параметра "совести", который обновляется на каждой итерации, препятствует слишком частым "победам" одних и тех же нейронов. Благодаря этому параметру пространство входных образов равномерно представляется всеми нейронами сети.

2) определение не нейрона-победителя, а множества ближайших нейронов, и настраивание весовых коэффициентов связей всех нейронов этого множества.

3) дифференцированная настройка весовых коэффициентов всех нейронов из окрестности нейрона-победителя.

Дата добавления: 2016-04-14; просмотров: 1823;