Эпсилон-энтропия непрерывного сообщения

Рассмотрим непрерывное сообщение в виде стационарного случайного процесса x(t) с известной одномерной плотностью вероятности рx(х).

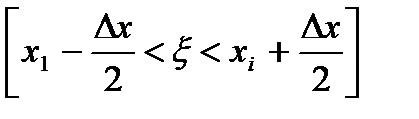

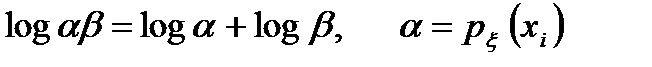

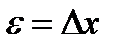

Проведём дискретизацию сообщения, для чего определим разрешённые уровни (х1,x2,...,xm). Вероятность нахождения случайной величины на интервале  в соответствии с процедурой квантования будем рассматривать как вероятность рi того, что дискрет сообщения примет значение хi, тогда при достаточно малом шаге квантования Dх будет иметь место равенство

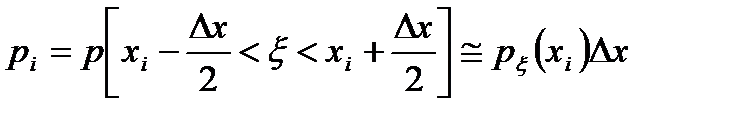

в соответствии с процедурой квантования будем рассматривать как вероятность рi того, что дискрет сообщения примет значение хi, тогда при достаточно малом шаге квантования Dх будет иметь место равенство

. (2.4)

. (2.4)

Квантование дискрета непрерывного сообщения позволяет заменить непрерывную функцию плотности вероятности сообщения px(x) рядом вероятности, у которого возможными значениями служат разрешённые уровни х1, х2,…хm , а их соответствующие вероятности вычисляются по формуле (2.4).

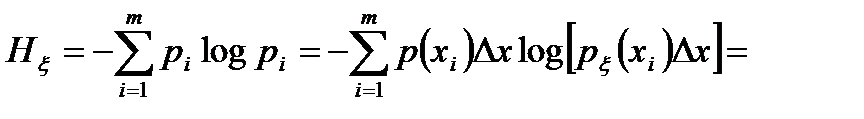

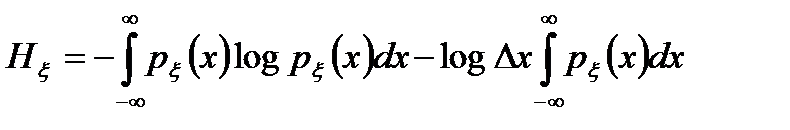

Вышеприведённые предпосылки позволяют для определения энтропии непрерывного сообщения воспользоваться формулой (1.7), полученной для дискретного сообщения. Подставив (2.4) в формулу (1.7), получим

, (2.5)

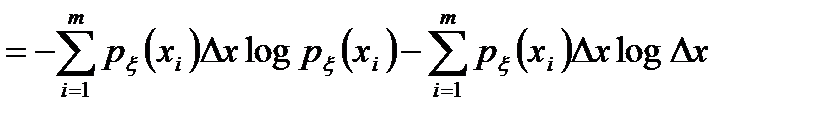

, (2.5)

где воспользовались соотношением  , b=Dх. Если устремить Dx®dx, то суммирование в (2.5) заменится интегрированием, которое распространим на всю числовую ось х. В то же время величину logDx, которая зависит от Dх и при его приближении к нулю стремится к "

, b=Dх. Если устремить Dx®dx, то суммирование в (2.5) заменится интегрированием, которое распространим на всю числовую ось х. В то же время величину logDx, которая зависит от Dх и при его приближении к нулю стремится к "  ", будем рассматривать как постоянную величину, не зависящую от х. В этом случае (2.5) примет вид

", будем рассматривать как постоянную величину, не зависящую от х. В этом случае (2.5) примет вид

. (2.6)

. (2.6)

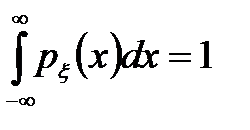

По условию нормировки плотности вероятности имеет место равенство

,

,

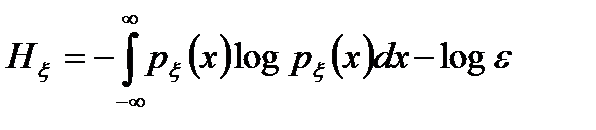

то формулу (2.6) можно записать в виде

, (2.7)

, (2.7)

где  - шаг квантования.

- шаг квантования.

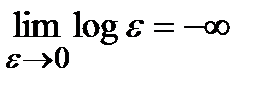

Из (2.7) следует, что энтропия непрерывного сообщения зависит как от плотности вероятности, так и от шага квантования. Причём при устремлении шага квантования к нулю теряется смысл выражения (2.7), так как

. (2.8)

. (2.8)

В литературе по теории информации величина (2,7) называется эпсилон-энтропией по названию буквы e, определяющей шаг квантования. Эпсилон-энтропию можно рассматривать как величину, определяющую среднее количество информации, приходящейся на один дискрет квантованного непрерывного сообщения.

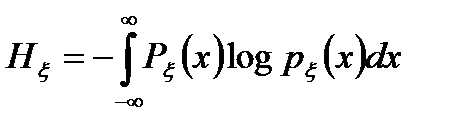

Если конечные расчётные формулы представлять в виде разности энтропии, определяемых для одного и того же e, то log e будет вычитаться. Сказанное позволяет не учитывать log e (или условно рассматривать e= 1) и в качестве энтропии непрерывного сообщения использовать зависимость

, (2.9)

, (2.9)

равную взятому со знаком минус математическому ожиданию логарифма плотности вероятности непрерывной случайной величины. В общем плане плотность вероятности рx(х) является размерной величиной. Чтобы избежать некорректности, под логарифмом необходимо ставить рx(х) в безразмерном виде, поделив её на единицу с размерностью плотности вероятности.

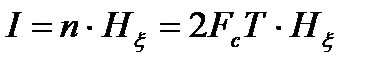

Энтропия (2.9) характеризует количество информации, приходящейся в среднем на один дискрет непрерывного сообщения. Если все дискреты на интервале [0, Т] являются независимыми случайными величинами, представляющими собой стационарный случайный процесс с одной и той же одномерной плотностью вероятности для всех своих сечений, то количество информации, заключённое в сообщении длительностью Т, определяется выражением

. (2.10)

. (2.10)

Формула (2.10) совпадает с выражением (2.16) для количества информации кодовой комбинации из n позиций в коде.

Дата добавления: 2016-01-26; просмотров: 1316;