Количественная мера информации. В теории информации количество информации, заключённое в сообщении, связывают с величиной неопределённости

В теории информации количество информации, заключённое в сообщении, связывают с величиной неопределённости, которая устраняется у получателя после того, как он это сообщение получит.

В простейшем случае для характеристики неопределенности какого-либо события обычно используется вероятность этого события. Это означает, что для определения количества информации также используется вероятностная мера.

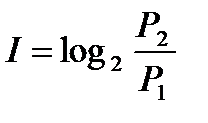

Пусть до получения сообщения получатель располагал априорной вероятностью Р1 наступления интересующего его события. После получения сообщений вероятность наступления этого события изменилась и стала равной Р2, при этом Р2 > Р1. Количество информации, которое в данном случае будет получено получателем, определим через логарифм отношения вероятностей:

(1.1)

(1.1)

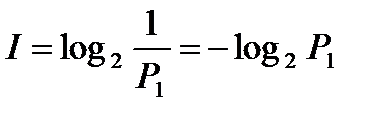

Если с получением сообщения у получателя исчезла полностью имевшаяся ранее неопределённость, то Р =1 и

(1.2)

(1.2)

В этом случае количество полученной информации определяется исключительно той априорной вероятностью, которой располагал получатель до получения сообщений.

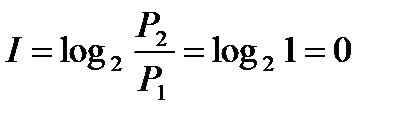

Если с получением сообщения неопределённость об интересующем событии у получателя не изменилась, то Р2 = Р1 и

то есть получатель в этом случае никакой информации об этом событии не получал.

Количество информации заключено в степени увеличения Р2 по отношению к Р1, в результате чего неопределённость уменьшается. Использование логарифма отношения в (1.1) обусловлено дополнительным требованием, чтобы информация о наступлении нескольких независимых событий, например и одного, и другого, представляемых в виде произведения этих событий, была бы равна сумме информации о каждом событии в отдельности. Этому требованию удовлетворяет логарифмическая функция, для которой log[P(A)Р(В)] = logP(A) + logP(B). Выбор основания логарифма с теоретической точки зрения является несущественным. Для практического использования оказалось удобным в формуле (1.1) выбрать логарифм при основании 2. Это обусловлено тем, что современные цифровые системы связи используют двоичные коды, состоящие из двух элементов «0» и «1».

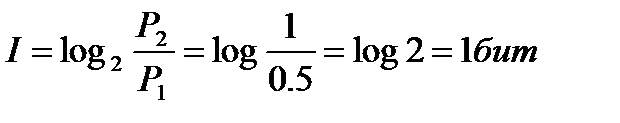

За единицу количества информации принимается такое её количество, которое содержится в сообщении о том, что произошло одно из двух равновозможных событий. Это количество информации составляет один «бит», сокращенное слово от английского "binary unit", что означает двоичная единица.

При определении количества информации в 1 бит имелось в виду, что Р1=0.5, а Р2 = 1. В этом случае согласно (1.1) имеем

,

,

где здесь и далее подразумевается, что основание логарифма равно двум. В дальнейшем основание 2 у логарифма писать не будем.

Дата добавления: 2016-01-26; просмотров: 1054;