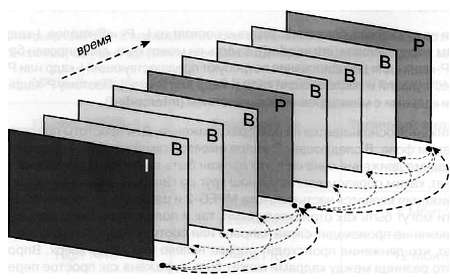

Набор I‑, Р‑ и В‑кадров в MPEG называется группой изображений (Group of Pictures , GOP).

Если группа изображений состоит только из одного изображения, то это будет только опорный l‑кадр, и такое кодирование будет выглядеть функциональным эквивалентом стандарта Motion‑JPEG. В этом случае устраняется только пространственная избыточность, но не временная. Когда группа изображений насчитывает 12 или 15 кадров, достигается оптимальный компромисс между уровнем сжатия и не слишком большой задержкой кодирования.

Типичные повторяющиеся структуры группы изображений из 9 кадров выглядят так:

IBBBPBBBP IBBBPBBBP IBBBPBBBP…

В MPEG появляется новый побочный эффект задержки кодирования, связанный с предсказанием движения. Эта та цена, которую мы платим в MPEG за лучшее качество изображения при сравнительно небольших видеопотоках. Большинство устройств, поддерживающих сжатие MPEG, позволяют устанавливать размер видеопотока и структуру группы изображений, а при выборе оптимальной комбинации этих параметров задержку кодирования можно снизить до незаметного глазу уровня за счет увеличения видеопотока и уменьшения размера группы изображений. В целом, количество элементов в группе изображений и определяет задержку кодирования. Так, например, для группы изображений из 12 кадров задержка кодирования составит половину секунды (для PAL), что уже существенно. А если к этому добавляется задержка на передачу по сети, то становится понятным, откуда берется в MPEG время задержки кодирования больше секунды.

Задержка кодирования может остаться незамеченной в системах видеонаблюдения, где используются только неподвижные телекамеры, но когда мы управляем поворотными телекамерами, эта задержка становится серьезной проблемой. Вполне закономерным будет вопрос о том, какая задержка кодирования MPEG и передачи по сети может считаться приемлемой. На самом деле это определяется скоростью реакции человека. Например, считается, что при управлении автомобилем скорость реакции человека не более 200 мс. Если мы опираемся на эти данные, что 200 мс будут считаться вполне приемлемой на практике задержкой.

Еще один интересный побочный эффект от двухстороннего предсказания движения в макроблоках проявляется в виде уменьшения шума из‑за усреднения.

На практике чаще всего MPEG‑1 используется для хранения видео на компакт‑дисках, но иногда этот стандарт находит применение в кабельном телевидении и в видеоконференциях. Впрочем, существуют и цифровые видеорегистраторы для видеонаблюдения, которые записывают видео в режиме реального времени и тоже используют MPEG‑1. Их применяют в том случае, когда скорость записи важнее, чем высокое разрешение. Большинство качественных цифровых видеорегистраторов, использующих MPEG‑2, обратно совместимы с MPEG‑1 и могут записывать и воспроизводить видеопоток стандарта MPEG‑1.

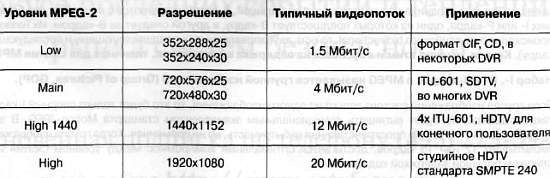

MPEG‑2

MPEG‑2 представляет собой не следующее поколение MPEG‑1, а скорее другой стандарт, нацеленный на более высокое качество передачи и записи цифровых движущихся изображений и звука. Он был предложен группой MPEG в 1993 и получил, как и MPEG‑1, престижную награду Emmy.

Стандарт MPEG‑2 определяет форматы кодирования для уплотнения цифрового видео высокого качества, звука и других данных в подходящий для передачи или хранения формат.

Так, MPEG‑2, подобно MPEG‑1, не ограничивает свои возможности только видео, но также работает с аудиопотоками. Здесь опять следует подчеркнуть, что MPEG‑2 является не схемой или техникой сжатия (как многие полагают), а скорее стандартизацией управления и обработки цифровых данных самым быстрым, оптимальным способом. Кодирование MPEG‑2 может генерировать скорости передачи данных значительно выше 18 Мбит/с, хотя при применении MPEG‑2 на практике в видеонаблюдении вы вряд ли заметите особую разницу между аналоговым видеосигналом и тем же видеопотоком размером 4 Мбит/с, сжатым MPEG‑2.

Стандарт MPEG‑2 разрабатывался для широкого круга применения, поэтому он позволяет использовать видеопотоки различного размера, качества и разрешения. В MPEG‑2 определено 4 профиля и 4 уровня для обеспечения взаимодействия в разных сферах применения. В профиле указано цветовое разрешение и размер видеопотока. Уровни определяют минимальное и максимальное разрешение изображения, частоту дискретизации яркостного (Y) сигнала, количество видео‑ и аудиослоев, поддерживаемых в масштабируемых профилях и максимальную скорость передачи данных для профиля.

Представляя собой совместимое расширение, видеостандарт MPEG‑2 основывается на MPEG‑1, поддерживая видеоформаты чересстрочного разложения и некоторые другие дополнительные свойства.

Формат MPEG‑2 используется в вещательном телевидении сервисными службами, такими, как DBS (Direct Broadcast Satellite – спутник прямого вещания), CATV (CAble Television – кабельное телевидение) и, что наиболее важно, HDTV (цифровое телевидение высокой четкости). Кроме того, формат DVD (который был стандартизирован в период между двумя изданиями этой книги) использует кодирование MPEG‑2 для видео‑ и аудиозаписей высокого качества. Благодаря сжатию MPEG‑2 однослойный и односторонний цифровой видеодиск DVD имеет достаточно емкости, чтобы хранить два часа и 13 минут видео высокого качества, объемного звука и субтитров.

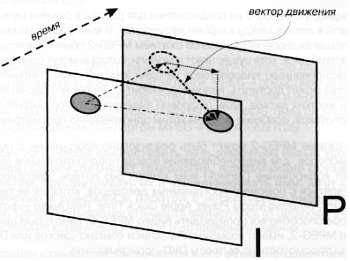

MPEG‑2, как и MPEG‑1, основывается на группах изображений, которые состоят из I‑, Р‑ и В‑кадров. 1‑кадр является опорным с внутрикадровым кодированием (intracoded), то есть он может быть декодирован без обращения к данным других кадров. Р‑кадры для декодирования потребуют предшествующий l‑кадр или Р‑кадр, В‑кадры потребуют уже предшествующий и последующий кадр (l‑кадр или Р‑кадр). Поэтому Р‑кадры и В‑кадры являются промежуточными кадрами с межкадровым кодированием (intercoded ).

Работа алгоритмов предсказания движения основывается на векторах движения. Для простоты представим, что в l‑кадре имеется круг на белом фоне. В следующем Р‑кадре имеется такой же круг, но уже смещенный в другую позицию. Предсказание движения означает, что должен быть вычислен вектор движения этого объекта, который описывает, каким образом двигается наш круг со своей позиции на l‑кадре в позицию на Р‑кадре. Этот вектор движения является частью потока MPEG‑2 и разделен на горизонтальную и вертикальную часть. Эти части могут быть как отрицательными, так и положительными. Положительное значение показывает, что движение происходит слева направо или соответственно сверху вниз.

Отрицательное значение показывает, что движение происходит справа налево или снизу вверх. Впрочем, такая модель подразумевает, что разница между кадрами может быть выражена как простое перемещение пикселов. В потоке MPEG имеется матрица ошибок предсказания, которая позволяет более точно восстанавливать движение.

Рис. 9.41. Векторы движения используются для предсказания смещения объектов между I‑ и Р‑кадрами

Когда только начинался переход к цифровым методам записи в видеонаблюдении (а это было совсем недавно, всего 5–6 лет назад), лишь очень немногие разработчики цифровых видеорегистраторов использовали стандарт MPEG‑2. Сейчас ситуация изменилась, и многие уже увидели преимущества качественной цифровой записи видео и другие достоинства MPEG‑2, с успехом нашедшие применение в видеонаблюдении – например, обратное воспроизведение архива, замедленное воспроизведение архива в прямом и обратном направлении, высокоскоростное воспроизведение архива (скорость может быть увеличена вплоть до 1024‑кратной) и даже детектирование движения.

Очевидно, что MPEG‑2 не предназначен для работы в режиме мультиплексированной записи, так как зависимость в потоке между кадрами нарушается, и выигрыш от межкадрового сжатия нивелируется. Поэтому цифровые видеорегистраторы со сжатием MPEG‑2 обычно записывают видеопотоки от одной телекамеры на жесткий диск, хотя существуют и модели, которые могут одновременно записывать и несколько (немультиплексированных) видеопотоков на один жесткий диск. Учитывая то, что видеопоток MPEG‑2 хорошего качества может достигать, например, 4 Мбит/с, несложно подсчитать, что при современном развитии технологии жестких дисков, один цифровой видеорегистратор сможет записывать всего лишь несколько таких видеопотоков, особенно если мы хотим одновременно просматривать архив.

Хотя сжатие MPEG‑2 может быть реализовано программно с помощью достаточно производительных процессоров, для видеонаблюдения всегда предпочтительнее выполнять сжатие аппаратно, что гарантирует кодирование (запись) всех кадров без потерь. Декодирование (воспроизведение) может осуществляться с помощью программных декодеров, которых не так уж и много, поскольку MPEG‑2 – это стандарт. Windows Media Player, Apple QuickTime, Real Audio – вот примеры программного обеспечения, которое способно воспроизводить видео MPEG‑2. Некоторые цифровые видеорегистраторы, использующие MPEG‑2, имеют возможность записи компакт‑дисков или DVD с видео MPEG‑2, такие диски затем можно просмотреть на бытовом DVD‑проигрывателе.

Многие производители цифровых видеорегистраторов высшего класса, помимо аппаратного сжатия и записи, позволяют декодировать сжатое видео и выводить его на отдельный аналоговый монитор и одновременно программно со смещением во времени декодировать запись для просмотра или для архивирования по сети. Возможность одновременного выполнения всех этих операций иногда называют триплексной функцией, но существуют и другие варианты: triplex, quad‑plex или penta‑plex . В последнем случае имеется в виду, что одновременно могут выполняться до 5 операций: запись, воспроизведение, архивирование на внешние носители, воспроизведение записи по сети и архивирование по сети. Если все эти процессы осуществляются с применением одного жесткого диска (как это обычно и происходит), то он должен иметь соответствующую скорость передачи данных. По этой причине многие производители цифровых видеорегистраторов предпочитают выпускать не многоканальные, а одноканальные устройства с записью MPEG‑2.

Рис. 9.42. В стандарте MPEG‑2 используется такая же структура с группами изображений, как и в MPEG‑1

MPEG‑2 пригоден для применения в различных областях индустрии безопасности, поскольку он позволяет получить лучшее качество изображения, но чаще всего этот стандарт находит применение там, где требуется запись быстрых движений, например, в казино и банках. Особенно внимательно следует подходить к использованию сжатия MPEG‑2 в тех случаях, когда требуется работать с поворотными телекамерами по сети, так как приходится учитывать задержку кодирования и передачи видеосигнала, но, как уже говорилось ранее, эту задержку можно сократить до приемлемых 200 мс и менее, манипулируя размерами видеопотока и структурой группы изображений.

Справедливости ради нужно отметить, что из‑за больших размеров видеопотока MPEG‑2 непригоден для удаленного просмотра и передачи данных по низкоскоростным каналам связи. Многие производители в этом случае предлагают использовать дополнительный стандарт MPEG‑4 (основным стандартом сжатия для записи остается MPEG‑2), так как он более гибок и адаптирован для передачи по низкоскоростным каналам связи (128 кбит/с, 256 кбит/с и др.).

MPEG‑4

MPEG‑4 (ISO 14496) – это еще один стандарт групп MPEG, разработанный относительно недавно. Его практически еще не использовали, когда вышло первое издание этой книги. MPEG‑4 представляет собой результат еще одного примера международного сотрудничества сотен исследователей и инженеров со всего мира. Работа над MPEG‑4, который официально обозначается как ISO/IEC 14496, была окончательно завершена в октябре 1998 года, а международным стандартом MPEG‑4 стал в 1999 году.

Стандарт MPEG‑4 был разработан для того, чтобы предоставить пользователям новый уровень взаимодействия с видеоинформацией. Он обеспечивает технологии, позволяющие осуществлять доступ не к пикселам, а к объектам, просматривать их и манипулировать ими. Этот стандарт отличается большой устойчивостью к ошибкам и работой с несколькими диапазонами значений скорости передачи данных. Сфера применения стандарта варьируется от цифрового телевидения, мультимедийных данных в мобильных коммуникациях, игр и до видеонаблюдения.

Основное отличие MPEG‑4 от предыдущих стандартов заключается в его объектно‑ориентированной аудиовизуальной модели. В рамках этой модели в каждой сцене присутствуют объекты, которые имеют связи между собой во времени и пространстве, что дает ряд преимуществ. Стандарт MPEG‑4 открывает пользователям новые возможности для создания, редактирования, доступа и потребления аудиовизуальной информации. В основе технологии MPEG‑4 лежит объектно‑ориентированный подход, где сцена моделируется как состоящая из объектов, как естественных, так и синтезированных, с которыми пользователь может взаимодействовать. Работа с объектами (особенно с синтезированными) и интерактивность лежат в основе MPEG‑4, но, к сожалению, в видеонаблюдении это не нашло применения.

Компенсация движения основана на блоках с соответствующей модификацией для границ объектов.

Размер блоков может быть 16x16 или 8x8 с половинным разрешением в пикселах. MPEG‑4 также обеспечивает режим компенсации движения с наложением. Кодирование текстур объектов основано на DCT‑преобразовании в блоках 8x8 с соответствующей модификацией для границ объектов. Для повышения эффективности кодирования также возможно предсказание коэффициентов. Статичные текстуры могут быть закодированы с использованием вейвлет‑преобразования. Устойчивость к ошибкам обеспечивается за счет маркеров ресинхронизации, декомпозицией данных и другими методами. Масштабируемость обеспечивается как для пространственного, так и временного улучшения разрешения. MPEG‑4 обеспечивает масштабируемость на уровне объектов с тем ограничением, что форма объекта должна быть прямоугольной. Для нас в видеонаблюдении это, возможно, самое полезное свойство, так как с ним связано масштабирование потоков для передачи по низкоскоростным каналам связи.

Стандарт MPEG‑4 был оптимизирован для передачи данных в трех диапазонах скоростей: менее 64 кбит/с, 64 – 384 кбит/с и 384 кбит/с – 4 Мбит/с.

MPEG‑4 предлагает набор инструментов и технологий, которые пригодны для различных областей применения как в существующих приложениях, так и в тех, которые появятся в будущем. Низкие скорости передачи данных и устойчивость к ошибкам позволяют использовать MPEG‑4 для надежной передачи по низкоскоростным радиоканалам, что удобно для мобильных видеофонов, коммуникаций в космосе и, конечно, в видеонаблюдении. Для высоких скоростей передачи данных в MPEG‑4 предусмотрены инструменты, которые упрощают передачу и хранение видео высокого качества, пригодного для телевизионных студий и других задач, требовательных к качеству видео. В процессе развития стандарта возникло несколько версий MPEG‑4, которые поддерживают больше скоростей передачи данных, чем MPEG‑2.

Основным применением стандарта MPEG‑4 вне индустрии безопасности является размещение интерактивного видео в сети Интернет. Сейчас очень популярно программное обеспечение, которое позволяет поместить «живое» видео MPEG‑4 на страницах сайта.

MPEG‑4 может работать с чересстрочной и прогрессивной разверткой, хотя последняя редко используется в видеонаблюдении. Поддерживается формат оцифровки 4:2:0. Это означает, что количество отсчетов при оцифровке цветоразностных сигналов СЬ и Сr составляет половину от количества отсчетов яркостного сигнала как по горизонтали, так и по вертикали. Для каждой компоненты допускается квантование от 4 до 12 бит.

Также как и в MPEG‑2, в стандарте MPEG‑4 имеется несколько различных профилей (Simple Profile, Core Profile и Main Profile ). Профили Simple Profile и Core Profile работают с видео формата QCIF и CIF со скоростью передачи данных 64 кбит/с, 128 кбит/с, 384 кбит/с и 2 Мбит/с. Профиль Main Profile может работать с разрешением CIF (352x288), полнокадровым разрешением, рекомендованным ITU‑R 601 (720x576), и высоким разрешением HDTV (1920x1080). Поддерживаются скорости передачи данных 2 Мбит/с, 15 Мбит/с и 38.4 Мбит/с.

MPEG‑4 разрабатывался не как монолитный стандарт, а скорее как набор инструментов, которые вместе с профилями обеспечивают решение конкретных задач. Хотя MPEG‑4 представляет собой достаточно обширный стандарт, он имеет такую структуру, которая позволяет получать доступ к разным инструментам по мере необходимости. Каждый разработчик может выбрать из обширного стандарта MPEG‑4 только тот инструментарий, который ему требуется, что с большой долей вероятности будет представлять очень незначительную часть стандарта.

Цифровые видеорегистраторы, работающие с MPEG‑4 становятся все более популярными в видеонаблюдении, хотя они и используют разные профили MPEG‑4 и, таким образом, отличаются по качеству изображения между собой.

MPEG‑4 не заменяет, как считают некоторые, стандарт MPEG‑2, но предлагает большую гибкость в работе на низкоскоростных каналах связи и позволяет передавать практически «живое» видео при скорости передачи 256 кбит/с. Некоторые производители включают MPEG‑4 в свои цифровые видеорегистраторы для удаленного просмотра и управления, тогда как для локальной записи используются другие алгоритмы сжатия.

Ведутся разработки и новых стандартов в ITU‑T и ISO. Последняя версия MPEG‑4 и новый стандарт Н.264 позволят повысить уровень сжатия до такой степени, что фильмы с высоким разрешением (HDTV) можно будет записывать на DVD‑диски высокой емкости.

MPEG‑7

Хотя MPEG‑7 и MPEG‑21 (описан далее) не используются в видеонаблюдении, здесь необходимо их упомянуть, так как они представляют собой дальнейшее развитие концепции сжатия изображения, а не просто очередную модификацию алгоритмов сжатия. MPEG‑1 и MPEG‑2 обеспечивают удобный способ представления аудиовизуальной информации, и этими алгоритмами сжатия пользуются в вещательном телевидении, в видеонаблюдении и при видеомонтаже. MPEG‑4 распространен еще более широко в различных сферах благодаря таким своим возможностям, как расширенный диапазон скоростей передачи, масштабируемость, устойчивость к ошибкам, гибкая интеграция объектов разных типов в рамках одной сцены и мощные методы добавления интерактивности в содержимое.

MPEG‑7 определяет взаимодействующую структуру для способов описания содержимого, помимо традиционных метаданных. Описательные элементы MPEG‑7 варьируются от цветов, форм и звуков до структурной информации высокого уровня о содержимом. MPEG‑7 также имеет уникальный инструментарий для структурирования информации о содержимом.

MPEG‑7 будет дополнять MPEG‑4, а не заменит его. MPEG‑4 определяет способ представления информации, a MPEG‑7 определяет способ описания. MPEG‑7 и MPEG‑4 создают очень мощную связку, особенно когда используются объекты MPEG‑4. С помощью MPEG‑7 теперь стало возможным обмениваться информацией мультимедийного содержания, что позволяет легко найти именно то, что требовалось. Этот набор инструментов может оказаться особенно полезным в видеонаблюдении, где очень часто приходится иметь дело с архивами продолжительностью в несколько недель, а то и месяцев, записанных на жестких дисках. MPEG‑7 поможет найти конкретные объекты, например, человека в красной рубашке или синюю машину, угнанную на улице.

MPEG‑7, несомненно, найдет в будущем широкое применение в вещательном телевидении, видеонаблюдении и будет использоваться поисковыми серверами для нахождения различной мультимедийной информации. Поиск мультимедийной информации значительно упростится особенно в тех случаях, когда мы имеем дело с огромными объемами информации, записанной на жестких дисках большого объем.

Хотя сейчас в видеонаблюдении используются цифровые видеорегистраторы с функцией интеллектуального поиска, которые позволяют находить объекты в определенных зонах активности (неактивности), такой поиск с использованием MPEG‑7 станет более мощным и гибким, что значительно повысит эффективность видеонаблюдения. Впрочем, это уже вопрос будущего.

MPEG‑21

MPEG‑21 – это еще один новый стандарт, который не используется в видеонаблюдении, но для полноты нашего описания мы немного расскажем и о нем. Задачей MPEG‑21 является создание «полной картины» того, как различные Цифровые Элементы выстраиваются в инфраструктуру для доставки и использования мультимедийного содержания. Мир MPEG‑21 состоит из Пользователей (Users), которые взаимодействуют с Цифровыми Элементами (Digital Items). Цифровым элементом может быть все, что угодно: от простой части мультимедийного содержания (одно изображение или звуковая дорожка) до целой коллекции видеозаписей. В качестве Пользователя MPEG‑21 может выступать любое лицо (от производителей и продавцов до потребителя). Интересно, что все Пользователи «равны» в MPEG‑21, так как у них у всех есть свои права и интересы в отношении Цифровых Элементов, а эти права и интересы необходимо выражать. Информация о распространении сама по себе представляет ценность, и конечный пользователь хотел бы иметь контроль над ее использованием. Серьезной движущей силой стандарта MPEG‑21 является то, что цифровая революция дает пользователю возможность играть новую роль в цепочке производства и распространения мультимедийной информации.

Н.320

Стандарт Н.320 представляет собой рекомендацию ITU‑T. Он состоит из серии других стандартов, каждый из которых отвечает за тот или иной аспект коммуникационной системы, то есть на самом деле является семейством стандартов. Например, стандарт Н.261 описывает кодирование видеоизображения, а Н.221 отвечает за мультиплексирование видеоинформации, аудиоинформации, данных и сервисной информации.

Рекомендация Н.320 предназначена в первую очередь для систем видеоконференции и видеофонов и оптимизирована для передачи данных по сети ISDN. При скорости передачи 128 кбит/с (два В‑канала ISDN) можно достичь неплохого качества изображения при очень хорошей скорости обновления кадров. Поскольку допустимая скорость передачи данных для этого стандарта лежит в диапазоне от 64 до 1920 кбит/с, то Н.320 можно использовать в коммуникационных сетях (локальных и глобальных) с различной пропускной способностью. Обратите внимание, что стандарт Н.320 был разработан для двустороннего общения между людьми и поэтому не имеет задержки в передаче данных, которая наблюдается в стандартах MPEG‑1 и MPEG‑2.

При двустороннем общении очень важно, чтобы отставание оставалось ниже 100–200 миллисекунд, иначе общение будет затруднено. Малое время задержки в передаче данных очень важно и в видеонаблюдении, особенно в тех случаях, когда необходимо удаленно управлять телекамерами. Поэтому некоторые производители цифровых видеорегистраторов используют при управлении телекамерами один из стандартов Н.320, тогда как в общем случае применяют другой стандарт сжатия. Н.320 также поддерживает возможность выбора приоритета качества изображения или скорости обновления.

Рекомендация Н.320 описывает не только кодирование изображения, но стандартизирует и другие компоненты коммуникационной системы. Большим преимуществом этого стандарта является высокая совместимость. Так, например, видеофон ISDN от одного производителя может обмениваться информацией системой видеоконференции ISDN от другого производителя или видеопередатчиком ISDN, если все они поддерживают стандарт Н.320.

Н.261

Н.261 является одним из самых старых стандартов сжатия и именно его некоторые производители цифровых видеорегистраторов воплотили в своей продукции в те времена, когда появились первые DVR.

Н.261 – это стандарт видеокомпрессии из семейства стандартов Н.320, которые разработаны для видеоконференций. На момент появления стандарта Н.261 (начало 1980‑х) не было сети Интернет, а самым быстрым способом передачи цифровой информации были линии ISDN. Поэтому вышедший в то время стандарт был оптимизирован для сжатия видеоизображения таким образом, чтобы его можно было передавать в диапазоне скоростей ISDN от 64 кбит/с до 1.5 Мбит/с. Так же, как стандарты MPEG, Н.261 определяет форматы как для хранения, так и для передачи сжатого видео. Более того, поскольку скорость передачи данных по линиям ISDN увеличивается с интервалом 64 кбит/с, то стандарт Н.261 позволяет настраивать уровень сжатия ступенчато, то есть постепенно увеличивая требуемую пропускную способность по 64 кбит/с.

Н.261 обычно работает с изображением формата CIF (352x288 пикселов для PAL и 352x240 пикселов для NTSC), который появился вместе с Н.261. Четверть этого разрешения также используется под именем QCIF (176x144 пиксела). Хотя стандарт Н.261 и предусматривает более высокое разрешение 704x576 пикселов, большинство цифровых видеорегистраторов со сжатием Н.261 используют формат CIF, сравнимый по качеству с VHS, как это было в случае и с MPEG‑1. Хотя на экране компьютера можно увеличить передаваемое изображение, разрешение от этого не возрастет, и будут отчетливо видны блоки и пикселы изображения.

Стандарт Н.261 нашел самое широкое применение в рамках семейства стандартов Н.261 для систем видеоконференции. Сжатие Н.261 не особенно эффективно для более качественного видео в видеонаблюдении, но было очень удобно для удаленного доступа по низкоскоростным каналам связи. Говоря об этом в прошедшем времени, я хочу подчеркнуть, что при работе на низкоскоростных каналах связи Н.261 значительно проигрывает MPEG‑4.

Н.263

Н.263 появился в 1996 году и стал дальнейшим развитием стандарта Н.261. Н.263 был специально оптимизирован для передачи изображения по очень низкоскоростным линиям связи со скоростью ниже 64 кбит/с в рамках семейства стандартов Н.320, например, для передачи по модему и телефонным линиям. Н.263 является альтернативой стандарту Н.261. При передаче изображений в сети GSM (9600 бит/с) и аналоговым телефонным линиям использование стандарта Н.263 позволяет несколько улучшить качество изображения и скорость обновления. На более высокоскоростных линиях связи качество будет сопоставимо с Н.261. Поскольку в стандарте Н.263 применен более эффективный алгоритм сжатия, то он позволяет добиться более высокого качества, чем у Н.261, на линиях связи с различной пропускной способностью, в том числе и ISDN. Н.263 позволяет передавать изображение с очень низкой скоростью передачи данных, как у модемов, скорость которых была в пределах 15–20 кбит/с. Первоначально планировалось с введением нового стандарта Н.263 сделать возможными видеоконференции по обычным телефонным линиям. Хотя для этой цели мог подойти формат QCIF, для того чтобы гарантировать работу на низкоскоростных линиях, решено было добавить еще один формат, который называется Sub‑QCIF (SQCIF). Но кроме этого, были добавлены форматы высокого разрешения, чтобы воспользоваться преимуществами новых коммуникационных технологий и высокоскоростных линий связи. SQCIF предусматривает очень низкое разрешение (128x96 пикселов). Два других новых формата высокого разрешения (704x576 и 1408x1152) являются дополнительными, так как оборудование Н.263 должно поддерживать в обязательном порядке только форматы SQCIF, QCIF и CIF.

Н.264

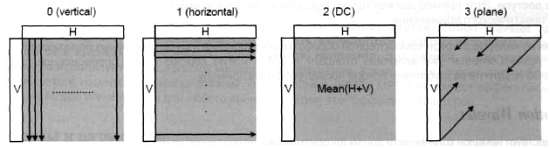

Н.264 – это один из самых многообещающих стандартов в череде новых разработок. Он разрабатывался совместно группой Video Coding Experts Group (VCEG) из ITU‑T и группой MPEG из ISO. Это историческое объединение известно как JVT (Joint Video Team ). Сам стандарт идентичен ISO MPEG‑4 part 10, который также известен как стандарт AVC для улучшенного кодирования видео (Advanced Video Coding). В черновом варианте стандарт Н.264 был готов к маю 2003 года, и в нем были реализованы технологии и особенности, взятые из Н.263 и MPEG‑4.

Рис. 9.43. Н.264 использует сложные алгоритмы предсказания в макроблоках

Н.264 – это название относится к серии Н.26х видеостандартов ITU‑T, тогда как AVC относится к серии MPEG‑стандартов ISO. Поэтому новый стандарт иногда называют H.264/AVC или AVC/H.264, чтобы подчеркнуть общность его корней. Название Н.261_тоже взято из истории ITU‑T, но оно встречается нечасто, хотя изредка и используется.

Основной целью проекта Н.264 была разработка стандарта, который можно было бы быстро внедрить, используя низкие скорости передачи данных, что, в свою очередь, снизило бы требования, предъявляемые к декодирующему оборудованию и линиям связи. Н.264 содержит несколько новых технологий, которые позволяют сжимать видео более эффективно, чем это делали используемые ранее стандарты. Например, в Н.264 для компрессии без потерь синтаксических элементов видеопотока используется схема статистического кодирования потока САВАС (Context‑Adaptive Binary Arithmetic Coding ). Также в стандарте Н.264 используется адаптивный фильтр для уменьшения артефактов блочности (Adaptive Deblocking Filter ), который применяется на стадии кодирования и декодирования видео, то есть фильтрация производится для каждого кадра еще до того, как он будет использован для кодирования или декодирования последующих кадров. Этот фильтр позволяет уменьшить присутствие блочных артефактов, характерных для алгоритмов сжатия, использующих дискретное косинусное преобразование. В предыдущих стандартах при оценке компенсации движения использовался только предшествовавший кадр, но Н.264 позволяет для этой цели использовать кадры, находящиеся сколь угодно далеко от обрабатываемого кадра. Для большинства сцен это дает достаточно скромное улучшение в качестве и небольшое уменьшение видеопотока, но в некоторых случаях, например, при быстрых периодических вспышках и мерцании это позволяет значительно уменьшить размер видеопотока. Эти идеи, а также и многие другие привели к тому, что Н.264 значительно более эффективен, чем MPEG‑4 ASP. Н.264 обычно работает более эффективно, чем MPEG‑2, при меньшем размере видеопотока. Различные тесты и сравнения показали, что стандарт Н.264, по крайней мере, в 2–3 раза более эффективен, по сравнению с MPEG‑2 при том же качестве изображения.

Рис. 9.44. Уже начали появляться дискиHD DVD емкостью 30 Гбайт

Кроме того, совместная группа JVT заканчивает работы над дополнениями к стандарту, которые получили название FRExt (Fidelity Range Extensions ). Эти дополнения позволят стандарту увеличить точность кодирования за счет поддержки 10‑ и 12‑битного кодирования и увеличения цветового разрешения с использованием форматов оцифровки, известных как YUV 4:2:2 и YUV 4:4:4.

Н.264 уже широко используется в сфере видеоконференций, он был предварительно принят как обязательный стандарт для будущих спецификаций DVD, которые также известны как HD‑DVD и разрабатываются DVD Forum.

Как и для многих видеостандартов ISO, для Н.264 есть пример реализации, который находится в свободном доступе. Этот пример должен только показать возможности нового стандарта, но не предназначен для практического применения.

Один из лидеров в сфере компьютерной обработки изображений и мультимедийных приложений компания Apple Computer уже включила стандарт Н.264 в новую версию своей операционной системы Mac OS X. Другие разработчики вскоре последуют этому примеру.

Motion Wavelet

Существует немалое количество и других алгоритмов сжатия видеоизображения, которые являются собственными разработками компаний‑производителей систем видеонаблюдения. По этой причине эти алгоритмы никак не стандартизированы, и такой работы даже не ведется. Кроме того, подробности реализации разработчики предпочитают не сообщать, так как это является коммерческой информацией. От детального рассмотрения таких алгоритмов на страницах книги мы воздержимся и в качестве примера приведем только один алгоритм сжатия видеоизображения Motion Wavelet, разработанный одной из российских компаний.

Motion Wavelet – алгоритм сжатия видеоизображения, то есть сжатие кадров основано на том, что они образуют видеопоследовательность. Motion Wavelet обрабатывает изменения, которые возникают в очередном кадре по сравнению с предыдущим либо с опорным кадром. Этим он отличается от алгоритмов сжатия изображения (JPEG и Wavelet), в которых применяется покадровое сжатие. Поэтому размер кадра в Motion Wavelet при сопоставимом качестве получается меньше в 5‑10 раз. Разница в среднем размере кадра будет зависеть от фона, наличия перемещающихся объектов и от других факторов.

В отличие от многих алгоритмов сжатия видеоизображения (например, алгоритмы MPEG) Motion Wavelet работает не по принципу вычитания кадров и сжатия полученной разницы. Motion Wavelet при анализе последовательности кадров использует детектор движения, который определяет на следующем кадре, какие элементы изображения изменятся, и сжимает только их. Если начинается движение во всем кадре, то будут обрабатываться и сжиматься все кадры полностью, что будет аналогично покадровому сжатию Wavelet. Впрочем, для видеонаблюдения именно сжатие, связанное с движением отдельных фрагментов, играет основную роль.

Обычно в тех алгоритмах, у которых сжатие основано на обработке разности кадров, не допускается изъятие хотя бы одного кадра из видеопотока, иначе он «распадается».

Эта проблема есть в наиболее распространенных реализациях алгоритма MPEG – они не могут адаптироваться к пропускной способности канала (например, при передаче видеоизображения по сети или по модему) и требуют канал фиксированной ширины. При использовании покадровых алгоритмов JPEG и Wavelet сжимается каждый кадр, поэтому здесь такая проблема отсутствует. Motion Wavelet может адаптироваться к каналу, поскольку если из потока, сжатого с его помощью, выкидывать блоки, то кадр потом можно будет восстановить, потому что сжатие очередного кадра по Motion Wavelet не имеет жесткой привязки к предыдущему кадру.

В наиболее распространенных реализациях алгоритма MPEG фиксируется величина сжимаемого потока. Это означает, что чем больше изменений происходит от кадра к кадру, тем хуже качество сжатого видеоизображения. Если в кадре ничего не изменяется, то качество сжатого изображения – отличное, но если объект начал двигаться, качество сжатого видеоизображения падает. Для видеонаблюдения такую ситуацию нельзя считать удовлетворительной, потому что здесь очень важно наблюдение с хорошим качеством именно движущихся объектов. В Motion Wavelet при наличии в кадре какого‑либо действия фиксируется качество: если в кадре начинается движение, то увеличивается величина сжатого потока, а качество остается стабильным.

Еще одна проблема, которая возникает при передаче видеоизображения по сети в форматах MPEG, заключается в том, что видеопоток, сжатый с одной скоростью (например, 25 к/с), без дополнительного перекодирования нельзя передавать меньшей скоростью из‑за жесткой привязки в последовательности кадров друг к другу. В алгоритмах Wavelet и JPEG нет этой проблемы. Она была решена и в алгоритме Motion Wavelet, который также позволяет при передаче пропускать кадры.

Так как Motion Wavelet для сжатия кадров использует вейвлет‑преобразование, то все преимущества этого сжатия сохранились. Благодаря масштабируемости вейвлет‑сжатия Motion Wavelet также позволяет из одного видеопотока быстро получать видеопотоки разного разрешения, когда видеопоток с высоким разрешением используется, например, для записи, а для удаленного просмотра используется видеопоток меньшего разрешения. Кроме того, в алгоритмах, использующих дискретное косинусное преобразование, как, например, JPEG и MPEG, возникает эффект блочности, но для Motion Wavelet, как и для любого вейвлет‑сжатия, этот эффект нехарактерен.

Дата добавления: 2015-05-08; просмотров: 1465;