Устранение гетероскедастичности

В случае, когда присутствие гетероскедастичности установлено, возникает необходимость преобразования регрессионной модели с целью устранения данного нежелательного явления. Вид преобразования зависит от того, известны или нет дисперсии случайных отклонений

Предположим, что рассматриваемая модель гетероскедастична, и нам известны значения дисперсий остатков  для каждого t-го наблюдения. При отсутствии автокорреляции это означает, что ковариационная матрица случайных отклонений V(e) = W - диагональная. В данном случае можно устранить гетероскедастичность, разделив каждое значение зависимой и объясняющих переменных на соответствующее стандартное отклонение

для каждого t-го наблюдения. При отсутствии автокорреляции это означает, что ковариационная матрица случайных отклонений V(e) = W - диагональная. В данном случае можно устранить гетероскедастичность, разделив каждое значение зависимой и объясняющих переменных на соответствующее стандартное отклонение  Нормируя («взвешивая») переменные по σi, мы стремимся получить более точные оценки. В этом заключается суть так называемого взвешенного метода наименьших квадратов (ВМНК).

Нормируя («взвешивая») переменные по σi, мы стремимся получить более точные оценки. В этом заключается суть так называемого взвешенного метода наименьших квадратов (ВМНК).

Для простоты изложения опишем ВМНК на примере парной регрессии:

yi = b0 + b1xi + ei. (5.7)

Разделим каждый член модели (5.7) на известное σi:

(5.8)

(5.8)

Введем обозначения  Тогда уравнение модели (5.7) примет вид:

Тогда уравнение модели (5.7) примет вид:

(5.9)

(5.9)

Полученное уравнение представляет собой регрессию без свободного члена, но с дополнительной объясняющей переменной U и с преобразованным случайным отклонением e*. Для преобразованной модели (5.9) дисперсия остатков  т. е. имеет место гомоскедастичность. Действительно, можно записать

т. е. имеет место гомоскедастичность. Действительно, можно записать

Так как, согласно первой предпосылке МНК, математическое ожидание М(ei) = 0, то

Так как, согласно первой предпосылке МНК, математическое ожидание М(ei) = 0, то  Следовательно,

Следовательно,

Таким образом, ковариационная матрица W в выражении (5.1) становится единичной, а сама преобразованная модель (5.9) – классической, к которой применим «обычный» МНК. Другими словами, в данном случае обобщенным методом наименьших квадратов для модели с гетероскедастичностью является взвешенный метод наименьших квадратов (ВМНК). «Взвешивая» каждый остаток  с помощью коэффициента 1/σi, мы добиваемся равномерного вклада остатков в общую дисперсию и, в конечном счете, получения эффективных оценок параметров модели.

с помощью коэффициента 1/σi, мы добиваемся равномерного вклада остатков в общую дисперсию и, в конечном счете, получения эффективных оценок параметров модели.

Рассмотренная выше процедура применения ВМНК предполагает, что фактические значения дисперсий  нам известны. Как уже было отмечено, такое предположение реализуется крайне редко. Для применения ВМНК на практике необходимо сделать некоторые достаточно реалистические предположения о значениях

нам известны. Как уже было отмечено, такое предположение реализуется крайне редко. Для применения ВМНК на практике необходимо сделать некоторые достаточно реалистические предположения о значениях  . Например, может оказаться целесообразным предположить, что дисперсии

. Например, может оказаться целесообразным предположить, что дисперсии  остатков ei пропорциональны значениям

остатков ei пропорциональны значениям  (стандартное отклонение остатков пропорционально независимой переменной) или значениям хi. Тогда необходимым преобразованием будет деление уравнения регрессии (5.7) на хi или

(стандартное отклонение остатков пропорционально независимой переменной) или значениям хi. Тогда необходимым преобразованием будет деление уравнения регрессии (5.7) на хi или  соответственно, что позволит нам получить «преобразованные» случайные отклонения

соответственно, что позволит нам получить «преобразованные» случайные отклонения  и

и  , для которых выполняется условие гомоскедастичности. Например, определим дисперсию случайного члена для случая пропорциональности стандартного отклонения значениям независимой переменной (σi = σ(ei) = lхi, где l - коэффициент пропорциональности). В силу выполнимости предпосылки МНК имеем:

, для которых выполняется условие гомоскедастичности. Например, определим дисперсию случайного члена для случая пропорциональности стандартного отклонения значениям независимой переменной (σi = σ(ei) = lхi, где l - коэффициент пропорциональности). В силу выполнимости предпосылки МНК имеем:

Несложно показать, что для отклонений  также выполняется условие гомоскедастичности. Таким образом, для оценки преобразованных регрессий возможно применение МНК.

также выполняется условие гомоскедастичности. Таким образом, для оценки преобразованных регрессий возможно применение МНК.

Рассматривая проведенные выше преобразования и их результаты, следует отметить, что применение обобщенного метода наименьших квадратов для моделей с гетероскедастичностью остатков заключается в минимизации суммы взвешенных квадратов отклонений выборочных данных от их оценок.

Автокорреляция

При анализе временных рядов часто приходится учитывать статистическую зависимость (коррелированность) наблюдений в разные моменты времени. Следовательно, в данном случае для регрессионных моделей Cov(ei, ej) ¹ 0, i ¹ j, т. е. третья предпосылка Гаусса-Маркова о некоррелированности остатков не выполняется. Такие регрессионные зависимости называются моделями с автокорреляцией (сериальной корреляцией) остатков. Для обобщенной линейной регрессионной модели с автокорреляцией ковариационная матрица случайных отклонений W не может быть диагональной.

Последствия автокорреляции остатков во многом сходны с последствиями гетероскедастичности (см. раздел 5.2). Среди них особенно следует выделить ухудшение прогнозных качеств моделей временных рядов.

Поскольку автокорреляция рассматривается в регрессионном анализе при использовании данных временных рядов, в дальнейших выкладках вместо символа i порядкового номера наблюдения будем использовать символ t отражающий момент наблюдения во времени (t = 1, 2, …, n). В экономических задачах более часто встречается так называемая положительная автокорреляция (Cov(et - 1, et) > 0 для соседних отклонений), нежели отрицательная автокорреляция (Cov(et - 1, et) < 0).

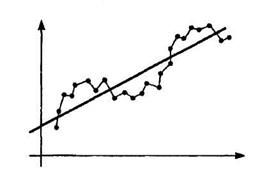

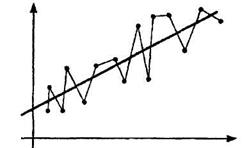

В большинстве случаев причиной положительной автокорреляции является направленное постоянное воздействие на исследуемый показатель некоторых неучтенных в модели факторов, что отражается на поведении случайного отклонения et. Пусть, например, исследуется спрос Y(yt) на прохладительные напитки в зависимости от дохода потребителей X по ежемесячным данным. Трендовая зависимость (основная тенденция), отражающая увеличение спроса с ростом дохода, может быть представлена линейной моделью  (рис. 5.2). Однако фактические точки наблюдений вследствие влияния фактора сезонности будут превышать трендовую линию в летние периоды и находиться ниже ее в зимние.

(рис. 5.2). Однако фактические точки наблюдений вследствие влияния фактора сезонности будут превышать трендовую линию в летние периоды и находиться ниже ее в зимние.

Рис. 5.2.

Если рассматривать в качестве примера временной ряд yt значений курса некоторой ценной бумаги, наблюдаемых в последовательные моменты времени, то естественно предположить, что результаты предыдущих торгов оказывают влияние на результаты последующих: завышенный (заниженный) в какой то момент времени курс скорее всего окажется завышенным (заниженным) по сравнению с реальным и на следующих торгах, т. е. здесь также может иметь место положительная автокорреляция.

Графически положительная автокорреляция выражается в чередовании зон, где наблюдаемые значения оказываются выше модельных (предсказанных), и зон, где наблюдаемые значения ниже (рис. 5.2).

Отрицательная автокорреляция характеризуется тем, что за положительным отклонением следует отрицательное и наоборот (принцип «маятника»). Примерная схема рассеивания точек относительно линии модели в случае отрицательной автокорреляции представлена на рис. 5.3.

Рис. 5.3.

Следует заметить, что автокорреляция чаще всего может быть вызвана неправильной спецификацией модели. Поэтому для ее возможного устранения следует скорректировать саму модель: включить в уравнение регрессии дополнительный фактор-аргумент или изменить формулу зависимости. Однако это далеко не всегда приводит к положительным результатам, что вызвано сложностью экономических процессов, влияющих на поведение случайных отклонений et. Если возможные процедуры изменения спецификации модели оказываются неэффективными, то необходимо воспользоваться так называемыми авторегрессионными преобразованиями над случайными отклонениями, среди которых наиболее простым и результативным является авторегрессионный процесс (авторегрессия) первого порядка. Авторегрессия первого порядка состоит в достаточно реалистичном предположении, что корреляция во времени наиболее сильно проявляется между двумя соседними отклонениями.

В целом для построения качественных моделей (особенно моделей временных рядов), наряду с проверкой общего качества уравнений регрессии, необходимо проводить их проверку на наличие автокорреляции остатков, и, в случае обнаружения, применять специальные методы по ее устранению.

Дата добавления: 2016-06-02; просмотров: 3535;