Понятие о марковских случайных процессах

Потоком событийназывают последовательность однородных событий, появляющихся одно за другим в случайные моменты времени. Примеры: поток вызовов на телефонной станции; поток сбоев ЭВМ; поток заявок на проведение расчетов в вычислительном центре и т.п.

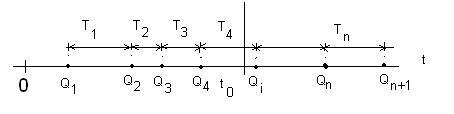

Поток событий наглядно изображается рядом точек с абсциссами Q1, Q2, ..., Qn, ... (рис. 6.15) с интервалами между ними: Т1 = Q2 - Q1, T2 = Q3 -Q2, ..., Тп = Qn+1 - Qn. При его вероятностном описании поток событий может быть представлен как последовательность случайных величин:

Q1; Q2 = Q1 + T1; Q3 = Q1 + T1 + T2; и т.д.

На рисунке в виде ряда точек изображен не сам поток событий (он случаен), а только одна его конкретная реализация.

Поток событий называется стационарным, если его вероятностные характеристики не зависят от выбора начала отсчета или, более конкретно, если вероятность попадания того или другого числа событий на любой интервал времени зависит только от длины этого интервала и не зависит от того, где именно на оси 0-t он расположен.

Рисунок 6.15 – Реализация потока событий

Поток событий называется ординарным, если вероятность попадания на элементарный интервал времени  двух или более событий пренебрежимо мала по сравнению с вероятностью попадания одного события.

двух или более событий пренебрежимо мала по сравнению с вероятностью попадания одного события.

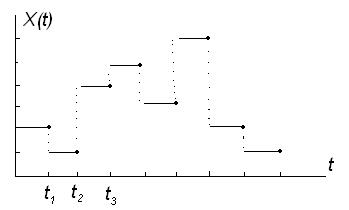

Рисунок 6.16 – Поток событий как случайный процесс

Ординарный поток событий можно интерпретировать как случайный процесс Х(t) - число событий, появившихся до момента t(рис. 6.16). Случайный процесс Х(t) скачкообразно возрастает на одну единицу в точках Q  ,Q2 ,...,Q n.

,Q2 ,...,Q n.

Поток событий называется потоком без последействия, если число событий, попадающих на любой интервал времени  , не зависит от того, сколько событий попало на любой другой не пересекающийся с ним интервал. Практически отсутствие последействия в потоке означает, что события, образующие поток, появляются в те или другие моменты времени независимо друг от друга.

, не зависит от того, сколько событий попало на любой другой не пересекающийся с ним интервал. Практически отсутствие последействия в потоке означает, что события, образующие поток, появляются в те или другие моменты времени независимо друг от друга.

Поток событий называется простейшим, если он стационарен, ординарен и не имеет последействия. Интервал времени T между двумя соседними событиями простейшего потока имеет показательное распределение

(при t>0); (6.21)

(при t>0); (6.21)

где  / М [Т] -величина, обратная среднему значению интервала Т.

/ М [Т] -величина, обратная среднему значению интервала Т.

Ординарный поток событий без последействия называется пуассоновским. Простейший поток является частным случаем стационарного пуассоновского потока. Интенсивностью  потока событий называется среднее число событий, приходящееся на единицу времени. Для стационарного потока

потока событий называется среднее число событий, приходящееся на единицу времени. Для стационарного потока  ; для нестационарного потока она в общем случае зависит от времени:

; для нестационарного потока она в общем случае зависит от времени:  .

.

Марковские случайные процессы. Случайный процесс называют марковским, если он обладает следующим свойством: для любого момента времени t0 вероятность любого состояния системы в будущем (при t >t0) зависит только от ее состояния в настоящем (при t =t0) и не зависит от того, каким образом система пришла в это состояние.

В данной главе будем рассматривать только марковские процессы c дискретными состояниями S1, S2, ...,Sn. Такие процессы удобно иллюстрировать с помощью графа состояний (рис. 5.4), где прямоугольниками (или кружками) обозначены состояния S1, S2, … системы S, а стрелками — возможные переходы из состояния в состояние (на графе отмечаются только непосредственные переходы, а не переходы через другие состояния).

Рисунок 5.4 – Граф состояний случайного процесса

Иногда на графе состояний отмечают не только возможные переходы из состояния в состояние, но и возможные задержки в прежнем состоянии; это изображается стрелкой («петлей»), направленной из данного состояния в него же, но можно обходиться и без этого. Число состояний системы может быть как конечным, так и бесконечным (но счетным).

Марковский случайный процесс с дискретными состояниями и дискретным временем обычно называют марковской цепью. Для такого процесса моменты t1, t2 ..., когда система S может менять свое состояние, удобно рассматривать как последовательные шаги процесса, а в качестве аргумента, от которого зависит процесс, рассматривать не время t, а номер шага: 1, 2, . . ., k;…. Случайный процесс в этом случае характеризуется последовательностью состояний

, (5.6)

, (5.6)

если S(0) — начальное состояние системы (перед первым шагом); S(1) — состояние системы непосредственно после первого шага; ...; S(k) — состояние системы непосредственно после k-го шага ....

Событие Si, , (i= 1,2,...) является случайным событием, поэтому последовательность состояний (5.6) можно рассматривать как последовательность случайных событий. Начальное состояние S(0) может быть как заданным заранее, так и случайным. О событиях последовательности (5.6) говорят, что они образуют марковскую цепь.

Рассмотрим процесс с n возможными состояниями S1, S2, ..., Sn. Если обозначить через Х(t) номер состояния, в котором находится система S в момент t, то процесс описывается целочисленной случайной функцией Х(t)>0, возможные значения которой равны 1, 2,...,n. Эта функция совершает скачки от одного целочисленного значения к другому в заданные моменты t1, t2, ... (рис. 5.5) и является непрерывной слева, что отмечено точками на рис. 5.5.

Рисунок 5.5 – График случайного процесса

Рассмотрим одномерный закон распределения случайной функции Х(t). Обозначим через  вероятность того, что после k-го шага [и до (k+1)-го] система S будет в состоянии Si (i=1,2,...,n). Вероятности рi(k) называются вероятностями состояний цепи Маркова. Очевидно, для любого k

вероятность того, что после k-го шага [и до (k+1)-го] система S будет в состоянии Si (i=1,2,...,n). Вероятности рi(k) называются вероятностями состояний цепи Маркова. Очевидно, для любого k

. (5.7)

. (5.7)

Распределение вероятностей состояний в начале процесса

p1(0) ,p2(0),…,pi(0),…,pn(0) (5.8)

называется начальным распределением вероятностей марковской цепи. В частности, если начальное состояние S(0) системы S в точности известно, например S(0)=Si, то начальная вероятность Pi (0) = 1, а все остальные равны нулю.

Вероятностью перехода на k-м шаге из состояния Si в состояние Sj называется условная вероятность того, что система после k-го шага окажется в состоянии Sj при условии, что непосредственно перед этим (после k - 1 шагов) она находилась в состоянии Si. Вероятности перехода иногда называются также «переходными вероятностями».

Марковская цепь называется однородной, если переходные вероятности не зависят от номера шага, а зависят только от того, из какого состояния и в какое осуществляется переход:

(5.9)

(5.9)

Переходные вероятности однородной марковской цепи Рij образуют квадратную таблицу (матрицу) размером n * n:

(5.10)

(5.10)

. (5.11)

. (5.11)

Матрицу, обладающую таким свойством, называют стохастической. Вероятность Рij есть не что иное, как вероятность того, что система, пришедшая к данному шагу в состояние Sj, в нем же и задержится на очередном шаге.

Если для однородной цепи Маркова заданы начальное распределение вероятностей (5.8) и матрица переходных вероятностей (5.10), то вероятности состояний системы  могут быть определены по рекуррентной формуле

могут быть определены по рекуррентной формуле

(5.12)

(5.12)

Для неоднородной цепи Маркова вероятности перехода в матрице (5.10) и формуле (5.12) зависят от номера шага k.

Для однородной цепи Маркова, если все состояния являются существенными, а число состояний конечно, существует предел  определяемый из системы уравнений

определяемый из системы уравнений  и

и  Сумма переходных вероятностей в любой строке матрицы равна единице.

Сумма переходных вероятностей в любой строке матрицы равна единице.

При фактических вычислениях по формуле (5.12) надо в ней учитывать не все состояния Sj, а только те, для которых переходные вероятности отличны от нуля, т.е. те, из которых на графе состояний ведут стрелки в состояние Si.

Марковский случайный процесс с дискретными состояниями и непрерывным временем иногда называют «непрерывной цепью Маркова». Для такого процесса вероятность перехода из состояния Si в Sj для любого момента времени равна нулю. Вместо вероятности перехода pij рассматривают плотность вероятности перехода  которая определяется как предел отношения вероятности перехода из состояния Si в состояние Sj за малый промежуток времени

которая определяется как предел отношения вероятности перехода из состояния Si в состояние Sj за малый промежуток времени  , примыкающий к моменту t, к длине этого промежутка, когда она стремится к нулю. Плотность вероятности перехода может быть как постоянной (

, примыкающий к моменту t, к длине этого промежутка, когда она стремится к нулю. Плотность вероятности перехода может быть как постоянной (  ), так и зависящей от времени [

), так и зависящей от времени [  ]. В первом случае марковский случайный процесс с дискретными состояниями и непрерывным временем называется однородным. Типичный пример такого процесса - случайный процесс Х(t), представляющий собой число появившихся до момента t событий в простейшем потоке ( рис. 5.2).

]. В первом случае марковский случайный процесс с дискретными состояниями и непрерывным временем называется однородным. Типичный пример такого процесса - случайный процесс Х(t), представляющий собой число появившихся до момента t событий в простейшем потоке ( рис. 5.2).

При рассмотрении случайных процессов с дискретными состояниями и непрерывным временем удобно представлять переходы системы S из состояния в состояние как происходящие под влиянием некоторых потоков событий. При этом плотности вероятностей перехода получают смысл интенсивностей  соответствующих потоков событий (как только происходит первое событие в потоке с интенсивностью

соответствующих потоков событий (как только происходит первое событие в потоке с интенсивностью  , система из состояния Si скачком переходит в Sj). Если все эти потоки пуассоновские, то процесс, протекающий в системе S, будет марковским.

, система из состояния Si скачком переходит в Sj). Если все эти потоки пуассоновские, то процесс, протекающий в системе S, будет марковским.

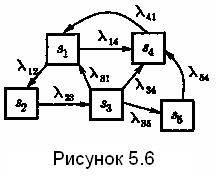

Рассматривая марковские случайные процессы с дискретными состояниями и непрерывным временем, удобно пользоваться графом состояний, на котором против каждой стрелки, ведущей из состояния Si , в Sj проставлена интенсивность  потока событий, переводящего систему по данной стрелке (рис.5.6). Такой граф состояний называют размеченным.

потока событий, переводящего систему по данной стрелке (рис.5.6). Такой граф состояний называют размеченным.

Вероятность того, что система S, находящаяся в состоянии Si, за элементарный промежуток времени (  ) перейдет в состояние Sj (элемент вероятности перехода из Si в Sj), есть вероятность того, что за это время dt появится хотя бы одно событие потока, переводящего систему S из Si в Sj. С точностью до бесконечно малых высших порядков эта вероятность равна

) перейдет в состояние Sj (элемент вероятности перехода из Si в Sj), есть вероятность того, что за это время dt появится хотя бы одно событие потока, переводящего систему S из Si в Sj. С точностью до бесконечно малых высших порядков эта вероятность равна  .

.

Потоком вероятности перехода из состояния Si в Sj называется величина  (здесь интенсивность

(здесь интенсивность  может быть как зависящей, так и независящей от времени).

может быть как зависящей, так и независящей от времени).

Рассмотрим случай, когда система S имеет конечное число состояний S1, S2,..., Sп. Для описания случайного процесса, протекающего в этой системе, применяются вероятности состояний

(5.13)

(5.13)

где рi (t) — вероятность того, что система S в момент t находится в состоянии Si:

. (5.14)

. (5.14)

Очевидно, для любого t

. (5.15)

. (5.15)

Для нахождения вероятностей (5.13) нужно решить систему дифференциальных уравнений (уравнений Колмогорова), имеющих вид

(i=1,2,…,n),

(i=1,2,…,n),

или, опуская аргумент t у переменных рi,

(i=1,2,…,n). (5.16)

(i=1,2,…,n). (5.16)

Напомним, что интенсивности потоков  ij могут зависеть от времени .

ij могут зависеть от времени .

Уравнения (5.16) удобно составлять, пользуясь размеченным графом состояний системы и следующим мнемоническим правилом: производная вероятности каждого состояния равна сумме всех потоков вероятности, переводящих из других состояний в данное, минус сумма всех потоков вероятности, переводящих из данного состояния в другие. Например, для системы S, размеченный граф состояний которой дан на рис. 10.6, система уравнений Колмогорова имеет вид

(5.17)

(5.17)

Так как для любого t выполняется условие (5.15), можно любую из вероятностей (5.13) выразить через остальные и таким образом уменьшить число уравнений на одно.

Чтобы решить систему дифференциальных уравнений (5.16) для вероятностей состояний р1(t) p 2(t), …, pn(t), нужно задать начальное распределение вероятностей

p1(0),p2(0), …,pi(0), …,pn(0), (5.18)

сумма которых равна единице.

Если, в частности, в начальный момент t = 0 состояние системы S в точности известно, например, S(0) =Si , и рi (0) = 1, то остальные вероятноcти выражения (5.18) равны нулю.

Во многих случаях, когда процесс, протекающий в системе, длится достаточно долго, возникает вопрос о предельном поведении вероятностей рi(t) при  . Если все потоки событий, переводящие систему из состояния в состояние, являются простейшими (т.е. стационарными пуассоновскими с постоянными интенсивностями

. Если все потоки событий, переводящие систему из состояния в состояние, являются простейшими (т.е. стационарными пуассоновскими с постоянными интенсивностями  ), в некоторых случаях существуют финальные(или предельные) вероятности состояний

), в некоторых случаях существуют финальные(или предельные) вероятности состояний

, (5.19)

, (5.19)

независящие от того, в каком состоянии система S находилась в начальный момент. Это означает, что с течением времени в системе S устанавливается предельный стационарный режим, в ходе которого она переходит из состояния в состояние, но вероятности состояний уже не меняются. В этом предельном режиме каждая финальная вероятность может быть истолкована как среднее относительное время пребывания системы в данном состоянии.

Систему, в которой существуют финальные вероятности, называют эргодической. Если система S имеет конечное число состояний S1 , S2 , . . . , Sn, то для существования финальных вероятностей достаточно, чтобы из любого состояния системы можно было (за какое-то число шагов) перейти в любое другое. Если число состояний S1 , S2 , . . . , Sn, бесконечно, то это условие перестает быть достаточным, и существование финальных вероятностей зависит не только от графа состояний, но и от интенсивностей  .

.

Финальные вероятности состояний (если они существуют) могут быть получены решением системы линейных алгебраических уравнений, они получаются из дифференциальных уравнений Колмогорова, если положить в них левые части (производные) равными нулю. Однако удобнее составлять эти уравнения непосредственно по графу состояний, пользуясь мнемоническим правилом: для каждого состояния суммарный выходящий поток вероятности равен суммарному входящему. Например, для системы S, размеченный граф состояний которой дан на р  ис. 5.7, уравнения для финальных вероятностей состояний имеют вид

ис. 5.7, уравнения для финальных вероятностей состояний имеют вид

(5.20)

(5.20)

Таким образом, получается (для системы S с п состояниями) система n однородных линейных алгебраических уравнений с n неизвестными р1, р2, ..., рп. Из этой системы можно найти неизвестные р1 , р2 , . . . , рп с точностью до произвольного множителя. Чтобы найти точные значения р1,..., рп, к уравнениям добавляют нормировочное условие p1 + p2+ …+ pп =1, пользуясь которым можно выразить любую из вероятностей pi через другие (и соответственно отбросить одно из уравнений).

Вопросы для повторения

1 Что называют случайной функцией, случайным процессом, сечением случайного процесса, его реализацией?

2 Как различаются случайные процессы по своей структуре и характеру протекания во времени?

3 Какие законы распределения случайной функции применяют для описания случайной функции?

4 Что представляет собой функция математического ожидания случайной функции, в чем ее геометрический смысл?

5 Что представляет собой функция дисперсии случайной функции, в чем ее геометрический смысл?

6 Что представляет собой корреляционная функция случайного процесса, и что она характеризует?

7 Каковы свойства корреляционной функции случайного процесса?

8 Для чего введено понятие нормированной корреляционной функции?

9 Объясните как по опытным данным получить оценки функций характеристик случайного процесса?

10 В чем отличие взаимной корреляционной функции от автокорреляционной функции?

11 Какой случайный процесс относят к стационарным процессам в узком смысле и в широком?

12 В чем заключается свойство эргодичности стационарного случайного процесса?

13 Что понимают под спектральным разложением стационарного случайного процесса и в чем его необходимость?

14 Какова связь между корреляционной функцией и спектральной плотностью стационарной случайной функции?

15 Что называют простейшим потоком событий?

16 Какой случайный процесс называют марковской цепью? В чем заключается методика расчета ее состояний?

17 Что представляет собой марковский случайный процесс с дискретными состояниями и непрерывным временем?

Упражнения

6.1 Случайная функция  , где U – случайная величина, возможные значения которой принадлежат интервалу (0,10). Найти реализации функции X(t) в двух испытаниях, в которых величина U приняла значения:

, где U – случайная величина, возможные значения которой принадлежат интервалу (0,10). Найти реализации функции X(t) в двух испытаниях, в которых величина U приняла значения:  .

.

6.2 Случайная функция  , где U – случайная величина. Найти сечения X(t), соответствующие фиксированным значениям аргумента:

, где U – случайная величина. Найти сечения X(t), соответствующие фиксированным значениям аргумента:  .

.

6.3 Найти математическое ожидание случайной функции:  , где U и V – случайные величины, причем M(U)=M(V)=1.

, где U и V – случайные величины, причем M(U)=M(V)=1.

6.4 Найти: а) математическое ожидание; б) корреляционную функцию; в) дисперсию случайной функции  , где U – случайная величина, причем M(U)=10, D(U)=0.2.

, где U – случайная величина, причем M(U)=10, D(U)=0.2.

6.5 Найти нормированную взаимную корреляционную функцию случайных функций X(t)=t*U и Y(t)=(t+1)U, где U – случайная величина, причем дисперсия D(U)=10.

Дата добавления: 2016-04-19; просмотров: 4480;