Пропускная способность систем передачи информации

Одной из основных характеристик любой системы передачи информации, кроме перечисленных выше, является ее пропускная способность.

Пропускная способность – максимально возможное количество полезной информации, передаваемое в единицу времени:

c = max{Imax} / TC ,

c = [бит/с].

Иногда скорость передачи информации определяют как максимальное количество полезной информации в одно элементарном сигнале:

s = max{Imax} / n,,

s = [бит/элемент].

Рассмотренные характеристики зависят только от канала связи и его характеристик и не зависят от источника.

Пропускная способность дискретного канала связи без помех. В канале связи без помех информацию можно передавать неизбыточным сигналом. При этом число n = m, а энтропия элементарного сигнала HCmax = logK.

max{IC} = nHCmax= mHCmax .

Длительность элементарного сигнала  , где

, где  – длительность элементарного сигнала.

– длительность элементарного сигнала.

где FC – спектр сигнала.

Пропускная способность канала связи без помех

Введем понятие скорости генерации элементарного сигнала источником информации:

Тогда, используя новое понятие, можно преобразовать формулу для скорости передачи информации:

c = BlogK.

Полученная формула определяет максимально возможную скорость передачи информации в дискретном канале связи без помех. Это следует из предположения о том, что энтропия сигнала максимальна.

Если HC < HCmax, то c = BHC и не является максимально возможной для данного канала связи.

Пропускная способность дискретного канала связи с помехами. В дискретном канале связи с помехами наблюдается ситуация, изображенная на рис. 6.

Рис.6

Учитывая свойство аддитивности, а также формулы Шеннона для определения количества информации, рассмотренные выше, можно записать

IC = TC FC log(AK PC),

IПОМ = TП FП log(APП).

Для получателя источник полезной информации и источник помехи равноценны, поэтому нельзя на приемной стороне выделить составляющую помехи в сигнале с результирующей информацией

IРЕЗ = TC FC log(AK (PП + PC)), если TC = TП , FC = FП .

Приемник может быть узкополосным, а помеха находиться в других интервалах частот. В этом случае она не будет влиять на сигнал.

Будем определять результирующий сигнал для наиболее “неприятного” случая, когда параметры сигнала и помехи близки друг к другу или совпадают. Полезная информация определяется выражением

Эта формула получена Шенноном. Она определяет скорость передачи информации по каналу связи в случае, если сигнал имеет мощность PC, а помеха – мощность PП. Все сообщения при такой скорости передадутся с абсолютной достоверностью. Формула не содержит ответа на вопрос о способе достижения такой скорости, но дает максимально возможное значение с в канале связи с помехами, то есть такое значение скорости передачи, при которой полученная информация будет абсолютно достоверной. На практике экономичнее допустить определенную долю ошибочности сообщения, хотя скорость передачи при этом увеличится.

Рассмотрим случай PC >> PП. Если ввести понятие отношения сигнал/шум

PC >> PП означает, что  . Тогда

. Тогда

Полученная формула отражает предельную скорость мощного сигнала в канале связи. Если PC << PП , то с стремится к нулю. То есть сигнал принимается на фоне помех. В таком канале в единицу времени сигнал получить не удается. В реальных ситуациях полностью помеху отфильтровать нельзя. Поэтому приемник получает полезную информацию с некоторым набором ошибочных символов. Канал связи для такой ситуации можно представить в виде, изображенном на рис. 7, приняв источник информации за множество передаваемых символов {X}, а приемник – за множество получаемых символов {Y}.

Рис.7 Граф переходных вероятностей K- ичного канала связи

Между  существует определенное однозначное соответствие. Если помех нет, то вероятность однозначного соответствия равна единице, в противном случае она меньше единицы.

существует определенное однозначное соответствие. Если помех нет, то вероятность однозначного соответствия равна единице, в противном случае она меньше единицы.

Если qi – вероятность принятия yi за xi, a pij = p{yi / xi} – вероятность ошибки, то

.

.

Граф переходных вероятностей отражает конечный результат влияния помехи на сигнал. Как правило, он получается экспериментально.

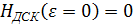

Полезная информация может быть оценена как IПОЛ = nH(X · Y), где n – количество элементарных символов в сигнале; H(X · Y) – взаимная энтропия источника X и источника Y.

В данном случае источником X является источник полезной информации, а источником Y является приемник. Соотношение, определяющее полезную информацию, можно получить исходя из смысла взаимной энтропии: заштрихованный участок диаграммы определяет сообщения, переданные источником Xи полученные приемником Y; незаштрихованные участки отображают сигналы источника X, не дошедшие до приемника и полученные приемником посторонние сигналы, не передаваемые источником.

B – скорость генерации элементарных символов на выходе источника.

Для получения max[H(Y) – H(Y/X)] нужно по возможности увеличить H(Y) и уменьшить H(Y/X). Графически эта ситуация может быть представлена совмещением кругов на диаграмме (Рис. 2г).

Если же круги вообще не пересекаются, X и Y существуют независимо друг от друга. В дальнейшем будет показано, как можно использовать общее выражение для максимальной скорости передачи при анализе конкретных каналов связи.

Характеризуя дискретный канал, используют два понятия скорости: техническая и информационная.

Под технической скоростью передачи RT, называемой также скоростью манипуляции, подразумевают число символов (элементарных сигналов), передаваемых по каналу в единицу времени. Она зависит от свойств линии связи и быстродействия аппаратуры канала.

С учетом различий в длительности символов техническая скорость определяется как

,

,

где  - среднее время длительности символа.

- среднее время длительности символа.

Единицей измерения  служит »бод» - это скорость, при которой за одну секунду передается один символ.

служит »бод» - это скорость, при которой за одну секунду передается один символ.

Информационная скорость или скорость передачи информации определяется средним количеством информации, которое передается по каналу за единицу времени. Она зависит как от характеристик конкретного канала (таких как объем алфавита используемых символов, технической скорости их передачи, статистического свойства помех в линии), так и от вероятностей поступающих на вход символов и их статистической взаимосвязи.

При известной скорости манипуляции  скорость передачи информации

скорость передачи информации  по каналу задается соотношением:

по каналу задается соотношением:

,

,

где  – среднее количество информации, переносимое одним символом.

– среднее количество информации, переносимое одним символом.

Для практики важно выяснить, до какого предела и каким путем можно повысить скорость передачи информации по конкретному каналу. Предельные возможности канала по передаче информации характеризуются его пропускной способностью.

Пропускная способность канала с заданными переходными вероятностями равна максимуму передаваемой информации по всем входным распределениям символов источника X:

С математической точки зрения поиск пропускной способности дискретного канала без памяти сводится к поиску распределения вероятностей входных символов источника Х, обеспечивающего максимум переданной информации  . При этом, на вероятности входных символов накладывается ограничение:

. При этом, на вероятности входных символов накладывается ограничение:  ,

,  .

.

В общем случае, определение максимума  при заданных ограничениях возможно с помощью мультипликативного метода Лагранжа. Однако такое решение требует чрезмерно больших затрат.

при заданных ограничениях возможно с помощью мультипликативного метода Лагранжа. Однако такое решение требует чрезмерно больших затрат.

В частном случае для дискретных симметричных каналов без памяти пропускная способность (максимум  , достигается при равномерном распределении входных символов источника X.

, достигается при равномерном распределении входных символов источника X.

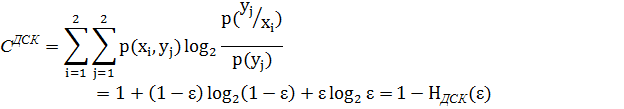

Тогда для ДСК без памяти, считая заданной вероятность ошибки ε и для равновероятных входных символов  =

=  =

=  =

=  =1/2, можно получить пропускную способность такого канала по известному выражению для

=1/2, можно получить пропускную способность такого канала по известному выражению для  :

:

где  =

=  – энтропия двоичного симметричного канала при заданной вероятности ошибки ε.

– энтропия двоичного симметричного канала при заданной вероятности ошибки ε.

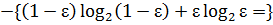

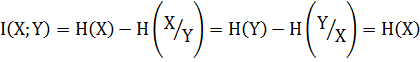

Интерес представляют граничные случаи:

1. Передача информации по бесшумному каналу (без помех):

,

,  [бит/символ].

[бит/символ].

При фиксированных основных технических характеристиках канала (например, полосе частот, средней и пиковой мощности передатчика), которые определяют значение технической скорости, пропускная способность канала без помех будет равна  [бит/сек].

[бит/сек].

Если же рассматривать канал не двоичный, а с заданным алфавитом входных символов, т.е. X={x1, x2, …,xM}, и его объемом M, тогда пропускная способность ДСК без памяти будет определяться как:

[бит/сек],

[бит/сек],

Так как  , а

, а  .

.

Следовательно, расширение объема алфавита входных символов M приводит к повышению пропускной способности канала, однако возрастает и сложность технической реализации.

Таким образом, для увеличения скорости передачи информации по дискретному каналу без помех и приближения ее к пропускной способности канала, последовательность букв сообщения должна подвергаться такому преобразованию в кодере канала, при котором различные символы в его выходной последовательности появлялись бы по возможности равновероятно, а статистические связи между ними отсутствовали бы. Такая процедура определяет согласование статистических (информационных) характеристик источника сообщения и канала связи.

Канал полностью зашумлен.

бит

бит

[бит/символ]

[бит/символ]

3.

В общем случае (при наличии помех) важно подчеркнуть, что пропускная способность канала определяет наибольшее количество информации в единицу времени, которое может быть передано со сколь угодно малой вероятностью ε.

Предельная возможность канала никогда не используется полностью. Степень его загруженности характеризуют коэффициентом использования канала.

,

,

где  - производительность источника

- производительность источника

- энтропия этого источника

- энтропия этого источника

- длительность выдачи одного символа источником

- длительность выдачи одного символа источником

[бит/сек].

[бит/сек].

Коэффициент канала λ иногда называют информационной эффективностью канала. А производительность источника  отождествляют со скоростью передачи информации, тогда

отождествляют со скоростью передачи информации, тогда

Дата добавления: 2015-12-26; просмотров: 5681;