Лекция 2 (Л-1.2). Информация и ее свойства.

Измерение информации. Системы счисления.

Основные понятия.

Понятие информацииявляется центральным для информатики. Точное выяснение понятия “информация” существенно необходимо для глубокого понимания систем обработки информации.

Термин “информация” происходит от латинского informatio, что означает разъяснение, осведомление, изложение. Понятие “информация” используется во многих областях знаний, поэтому многозначно, так что определить его исчерпывающим образом через более простые понятия невозможно.

В широком смысле, с позиции материалистической философии, информация есть отражение реального мира с помощью сведений в какой-либо форме (речь, текст, график, цифровые данные и т.п.). Информацию как философскую категорию рассматривают как один из атрибутов материи, отражающей ее структуру. В рамках науки информатики информация является основополагающим понятием. Любая деятельность человека представляет собой процесс сбора и переработки информации, принятия на ее основе решений и их выполнения. С появлением современных средств вычислительной техники информация стала выступать в качестве одного из важнейших ресурсов научно-технического прогресса.

В техникепод информацией понимают все сведения, являющиеся объектом хранения, передачи и преобразования. Многие формы представления информации допускают различное толкование. Одна и та же последовательность литер (одно слово) может иметь разные толкования, как и наоборот одно и то же смысловое содержание может быть представлено различными способами. Поэтому, вообще говоря, следует различать информацию и форму ее представления. Выявление подходящих систем представления (“языков”) для определенных классов информации является одной из задач информатики. Кроме того, абстрактная информация не всегда является отражением реального мира в конкретных условиях (например: осень - дождливая пора, но конкретная осень какого-то года может быть не дождливой, или отдельные конкретные осенние дни могут быть жаркими и без осадков).

Таким образом, в связи с информацией различают:

ее представление или изображение (внешняя форма)

ее значение

ее отношение к реальному миру (связь абстрактной информации с действительностью при интерпретации ее к конкретным условиям реального мира).

Информация – абстрактное содержание (содержательное значение, семантика) какого-либо высказывания, описания, указания, сообщения или известия. Внешнюю форму изображения называют представлением информации.

Информация – сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний.

С понятием информации связаны такие понятия, как сигнал, сообщение, сведения, данные.

Сигнал – любой процесс, несущий информацию.

Сообщение – это информация, представленная в определенной форме и предназначенная для передачи.

Сведения –это смысл, который хочет и может передатьодин человек другому или группе людей с помощью сообщений.

Данные – это информация, представленная в формализованном виде и предназначенная для обработки ее техническими средствами, например, ЭВМ.

| По способам восприятия | По форме представления | По общественному значению |

| Визуальная. Аудиальная. Тактильная. Обонятельная. Вкусовая. | Текстовая. Числовая. Графическая. Музыкальная. Комбинированная. | Массовая: -обыденная; -общественно-политическая; -эстетическая. Специальная: -научная; -производственная; -техническая; -управленческая. Личная: -знания; -умения; -интуиция. |

Информация классифицируется следующим образом:

Меры информации.

Единица измерения информации была определена в науке под названием «теория информации». Информацию измеряют в битах. Бит – это один разряд в ячейке компьютерной памяти. В один разряд можно вписать только одну цифру (0 или 1). Это очень маленькая величина, поэтому используют величину в 8 раз больше – байт. Т.о. байт - это 8 бит. Для измерения больших объемов информации используются производные от байта единицы:

1 килобайт = 1 Кб = 1024 байта

1 мегабайт = 1 Мб = 1024 Кб

1 гигабайт = 1 Гб = 1024 Мб

1 терабайт = 1 Тб = 1024 Гб и т.д.

Теория информации рассматривает следующие меры количества информации:

I. Синтаксическая мера информацииоперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. На этом уровне объем данных в сообщении измеряется количеством символов в этом сообщении.

Рассмотрим два подхода к измерению синтаксической информации.

1. Содержательный подход. Информация измеряется в битах, байтах и т.д., т.е. для определения количества применяется двоичная система счисления. Минимальная единица – бит.

Количество информации i, содержащееся в сообщении о том, что произошло одно из N равновероятных событий, определяется из решения показательного уравнения

2 i = N (1)

В общем виде

m n = N (2)

Эту формулу в 1928 году вывел Ричард Хартли. В ней

N – количество равновероятных событий,

n – число разрядов (символов в сообщении),

m – основание системы счисления.

Для двоичной системы счисления m = 2, n = i, т.о.

2 i = N, или i = log 2 N (3)

Эта формула является частным случаем формулы Клода Шеннона, когда количество информации определяется не через количество возможных равновероятных событий, а через вероятность. Величина вероятности определяется в долях или процентах и

0% < P < 100%

или

0 < P < 1.

Если события не равновероятны, то согласно теории информации нужно решить показательное уравнение (получено из формулы Шеннона)

2 i = 1/P или i = log 2 (1/P) (4)

P – вероятность события. Чем меньше вероятность, тем больше информации.

2. Алфавитный подход. При этом подходе используется мощность алфавита N (в том числе знаки препинания и пробел). Расчет осуществляется по формулам (3). Каждый символ несет i бит информации. Например, в русскоязычном алфавите 54 символа, т.е. N = 54, следовательно i = log254 = 5,75. Количество информации, содержащееся в символьном сообщении К*i, где К – количество символов сообщения, i - информационный вес символа алфавита, мощность которого N.

II. Семантическая мера информации используется для измерения смыслового содержания информации. Наибольшее распространение здесь получила тезаурусная мера, предложенная Ю.И. Шнейдером (идеи тезаурусного метода были сформулированы еще основоположником кибернетики Н. Винером) и связывающая семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для понимания и использования информации ее получатель должен обладать определенным запасом знаний.

Тезаурус — это совокупность сведений, которыми располагает пользователь или система. Максимальное количество семантической информации потребитель получает при согласовании ее смыслового содержания со своим тезаурусом, когда поступающая информация понятна пользователю и несет ему ранее не известные сведения.

Семантический подходопределения количества информации является наиболее трудно формализуемым и до сих пор окончательно не определившимся. Тем не менее…:

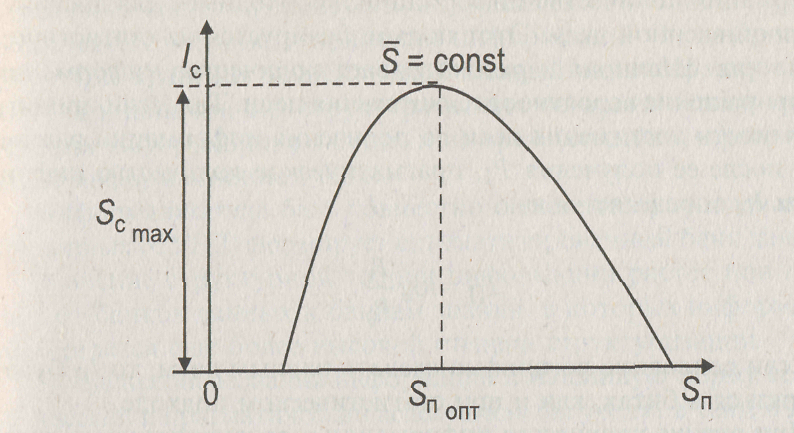

Если индивидуальный тезаурус потребителя Sпотражает его знания о данном предмете, то количество смысловой информации Iс, содержащееся в некотором сообщении, можно оценить степенью изменения этого тезауруса, произошедшего под воздействием данного сообщения. Очевидно, что количество информации Iс нелинейно зависит от состояния индивидуального тезауруса пользователя, и хотя смысловое содержание сообщения Sп постоянно, пользователи, имеющие различные тезаурусы, будут получать неодинаковое количество информации. В самом деле, если индивидуальный тезаурус получателя информации близок к нулю (Sп ~ 0), то в этом случае и количество воспринятой информации равно нулю: Iс = 0.

Иными словами, получатель не понимает принятого сообщения и, как следствие, для него количество воспринятой информации равно нулю. Такая ситуация эквивалентна прослушиванию сообщения на неизвестном иностранном языке.

Несомненно, сообщение не лишено смысла, однако оно непонятно, а значит, не имеет информативности.

Количество семантической информации Icв сообщении также будет равно нулю, если пользователь информации абсолютно все знает о предмете, т.е. его тезаурус Sпи сообщение не дают ему ничего нового.

Интуитивно мы чувствуем, что между этими полярными значениями тезауруса пользователя существует некоторое оптимальное значение Sпопт при котором количество информации Ic, извлекаемое из сообщения, становится для получателя максимальным. Эта функция зависимости количества информации Icот состояния индивидуального тезауруса пользователя Sп приведена на рисунке.

Тезаурусный метод подтверждает тезис о том, что информация обладает свойством относительности и имеет, таким образом, относительную, субъективную ценность. Для того чтобы объективно оценивать научную информацию, появилось понятие общечеловеческого тезауруса, степень изменения которого и определяла бы значительность получаемых человечеством новых знаний.

III. Прагматическая мера информацииопределяет ее полезность, ценность для процесса управления. Обычно ценность информации измеряется в тех же единицах, что и целевая функция управления системой.

Прагматический подход определяет количество информации как меры, способствующей достижению поставленной цели. Одной из первых работ, реализующей этот подход, явилась статья А.А. Харкевича. В ней он предлагал принять за меру ценности информации количество информации, необходимое для достижения поставленной цели. Этот подход базируется на статистической теории Шеннона и рассматривает количество информации как приращение вероятности достижения цели. Так, если принять вероятность достижения цели до получения информации равной Ро, а после ее получения Р1, прагматическое количество информации Iп определяется как

Iп = log Р1/ Ро

Если основание логарифма сделать равным двум, то Iп будет измеряться в битах, как и при синтаксическом подходе.

При оценке количества информации в семантическом и прагматическом аспектах необходимо учитывать и временную зависимость информации. Дело в том, что информация, особенно в системах управления экономическими объектами, имеет свойство стареть, т.е. ее ценность со временем падает, и важно использовать ее в момент наибольшей ценности.

Дата добавления: 2017-04-20; просмотров: 757;